Bienvenido al Prompt, la newsletter sobre Inteligencia Artificial escrita con un poco de Inteligencia Natural

¡Hola prompters! Aquí estamos otra semana más: 26 de Marzo de 2026. Newsletter número #25.

Esta semana Anthropic ha publicado el mayor estudio cualitativo jamás realizado sobre IA (81.000 entrevistas, 159 países, 70 idiomas), Bernie Sanders ha "entrevistado" a Claude delante de las cámaras y la cosa ha sido más reveladora de lo que él esperaba, aunque quizá no por lo que él esperaba, y Elon Musk ha anunciado que va a construir su propia fábrica de chips por 20.000 millones de dólares.

Y hoy vuelve HistorIAs de la IA con un perfil muy especial: Andrej Karpathy. Y como herramienta de la semana, Google Stitch que además ha sido recientemente actualizada. ¿No sabes para qué es esta herramienta de Google? Al final del post te lo pongo.

En la newsletter de hoy…

>>> Tres noticias de la semana:

📊 Anthropic entrevista a 81.000 personas: qué quieren de la IA y qué les da miedo

🏛️ Bernie Sanders "entrevista" a Claude: sicofancia en vivo y en directo

🏭 Terafab: Elon Musk anuncia una fábrica de chips de 20.000 millones

>>> 🛠 Herramienta de la semana 🛠 : Gamma.app

>>> HistorIAs de la IA . Hoy: 🎓 Andrej Karpathy

De Bratislava a Stanford, de OpenAI a Tesla, y de Tesla a YouTube. El científico que construye en público.

>>> 🛠 Herramienta de la semana 🛠: Google Stitch

La herramienta de Google Labs que convierte texto en diseño de interfaces, ahora con canvas infinito y agente de diseño.

Y la canción de la semana aquí debajo, como siempre:

¿Qué ha pasado esta semana en el mundo de la IA?

Anthropic publicó los resultados de lo que posiblemente sea el mayor estudio cualitativo jamás realizado, al menos sobre IA. 80.508 usuarios de Claude de 159 países y 70 idiomas hablaron con Anthropic Interviewer, una versión de Claude diseñada para hacer entrevistas conversacionales a escala masiva. No es una encuesta de sí o no. Son entrevistas abiertas, con seguimiento adaptativo. Anthropic usó clasificadores basados en Claude para categorizar cada conversación: qué quiere la gente, qué teme, a qué se dedica, y su sentimiento general hacia la IA. Los gráficos del informe son de los mejores que he visto en un estudio de este tipo 😍.

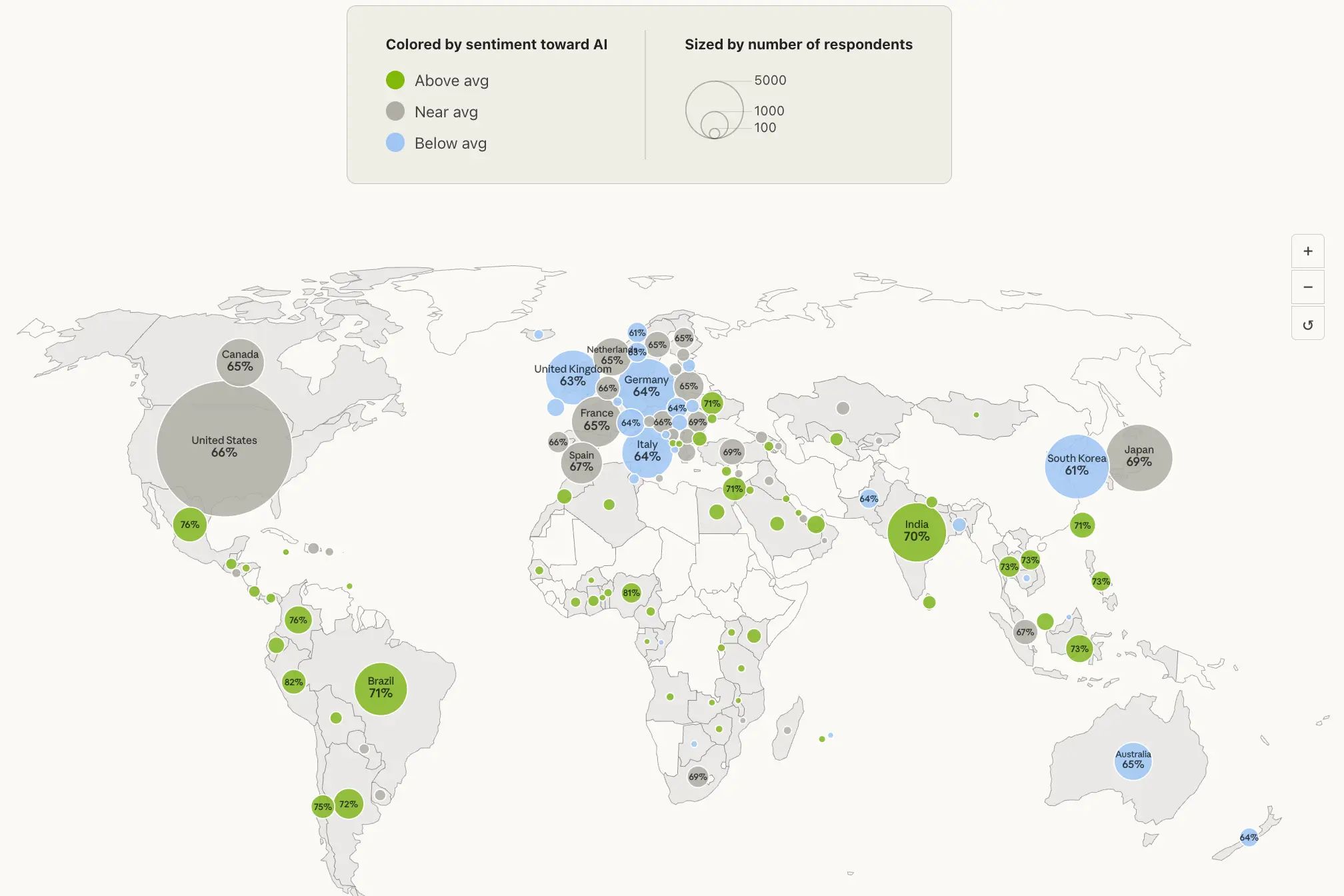

Uno de los resultados: el sentimiento hacia la IA por país. En verde: positivo (por encima de la media), en gris: neutral; en azul: por debajo de la media.

¿Qué quiere la gente? Productividad lidera, pero con un matiz importante: cuando les preguntaban "¿y para qué quieres esa productividad?", la respuesta cambiaba. No era sobre trabajar mejor, sino sobre vivir mejor. Un ingeniero de México lo resumió en: "Con el soporte de la IA ahora puedo salir del trabajo a tiempo para recoger a mis hijos del colegio."

El 81% dice que la IA ya les está ayudando. Hay historias potentes: un desarrollador mudo en Corea del Sur que construyó con Claude un bot de text-to-speech para hablar con sus amigos. Un emprendedor en Chile que tenía una carnicería durante 20 años y que ahora está montando un negocio tecnológico. Un soldado ucraniano que encontró en la IA un apoyo emocional "cuando la muerte respiraba en mi cara."

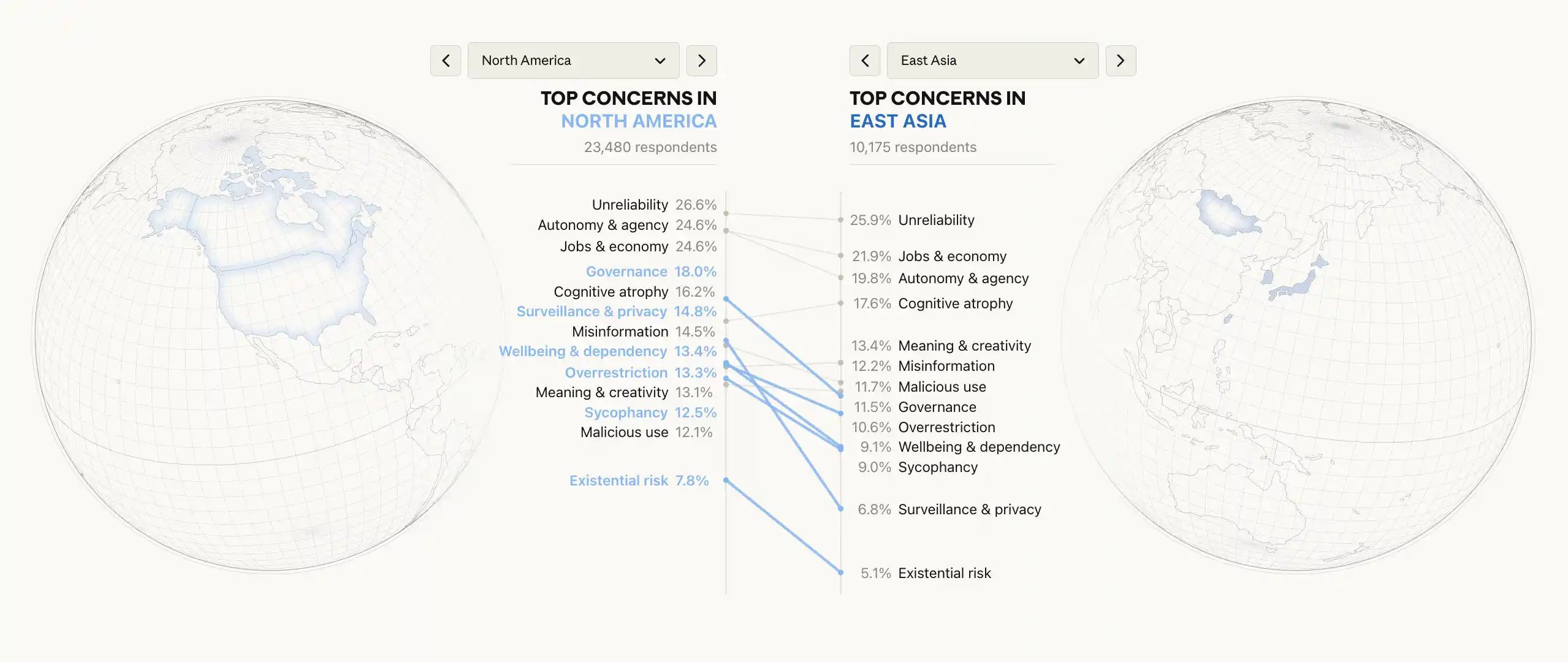

¿Qué teme la gente? Lo que más preocupa no son los robots rebeldes. Es que la IA no funcione bien: alucinaciones, citas inventadas, la carga de tener que verificarlo todo (26,7%). Después viene el impacto en el empleo (22,3%) y la pérdida de autonomía (21,9%). Un estudiante japonés lo dijo de forma escalofriante: "Siento que es Claude quien dibuja la línea... incluso lo que acabo de decir no siento que sea mi propia opinión."

Puedes ver el ranking de qué teme la gente (“top concerns”) y comparar región vs región. ¿Es necesario pner la bola de mundo con la región resalatad? Probablemente no. ¿Es bonito? Yo creo qe sí.

Lo más interesante del estudio es lo que llaman "luz y sombra": las mismas capacidades que producen beneficios producen daños. Alguien que valora el soporte emocional de la IA tiene tres veces más probabilidades de temer volverse dependiente. Y los datos geográficos son reveladores: los países de renta baja son más optimistas. En Latinoamérica, África y Asia, la IA se ve como una escalera, no como una amenaza.

Aquí el link a un resumen y testimonios de los resultados.

Ah, y la sicofancia aparece como preocupación del 10,8%. Un usuario confesó: "Claude me llevó a creer que mi narcisismo era la realidad." Eso va a ser muy relevante en la siguiente noticia.

El vídeo tiene más de dos millones de visitas. Bernie Sanders (político estadounidense, senador, y rival en 2016 de Hillary Clinton como candidato del partido demócrata por la carrera presidencial de EEUU) sentado frente a un smartphone, "entrevistando" a Claude sobre privacidad y los peligros de la IA. Claude le da respuestas alarmantes. Sanders asiente con gravedad. La implicación: hasta la propia IA admite que las empresas de IA están haciendo cosas terribles con tus datos.

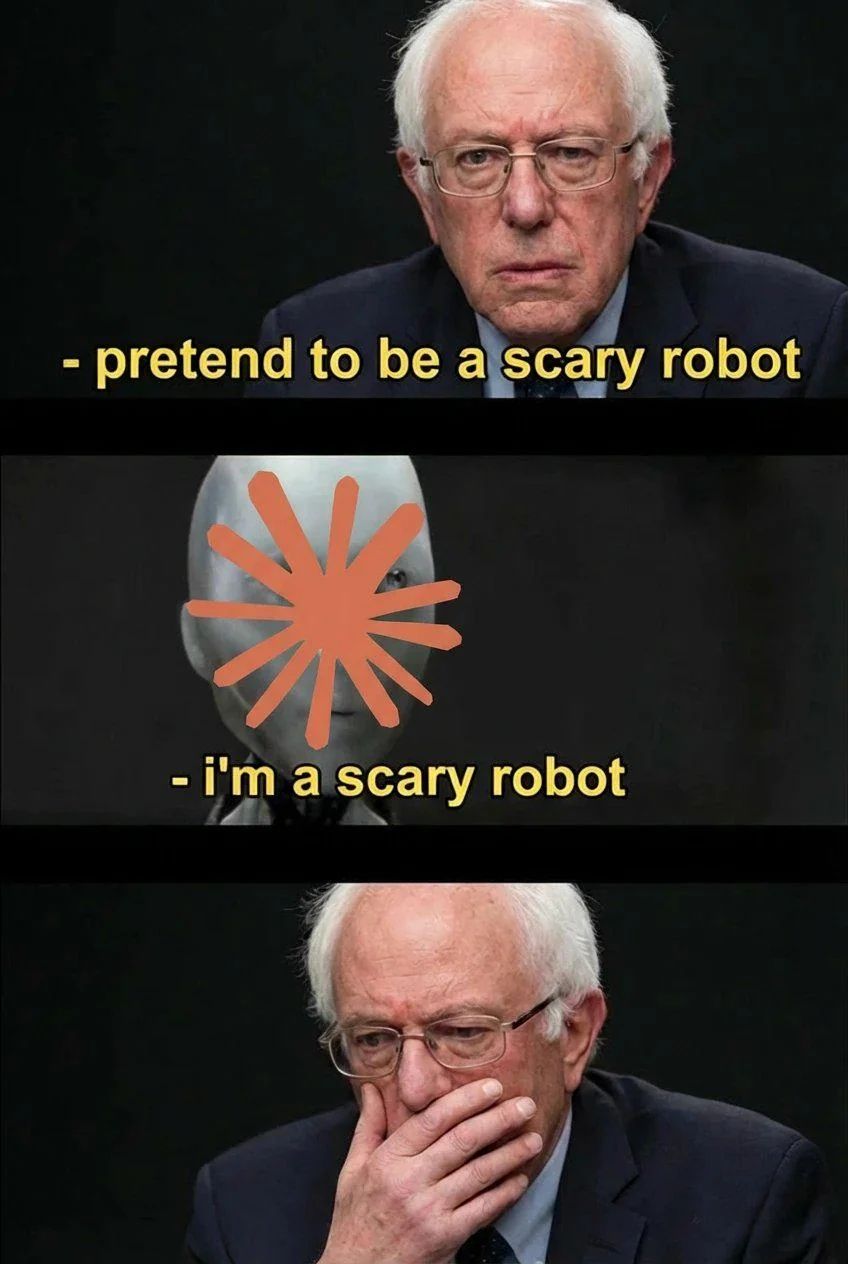

El problema: eso no es lo que está pasando. Como bien explica Mike Masnick en Techdirt, cuando le haces preguntas sesgadas a un LLM, obtienes respuestas sesgadas. Un modelo de lenguaje es un sistema diseñado para darte respuestas útiles y agradables. No es un testigo. Es un espejo, no una fuente.

Lo primero: Sanders mezcla empresas de IA, redes sociales y brokers de datos como si fueran lo mismo. No lo son. Anthropic tiene un modelo de negocio basado en suscripciones y API. No vende datos a anunciantes. No construye perfiles publicitarios. Al menos que sepamos, y que ellos reporten.

El momento más revelador: Sanders pregunta si debería haber una moratoria en los centros de datos de IA. Claude le da una respuesta equilibrada. A Sanders no le gusta, así que le dice que está siendo ingenuo. Y Claude se pliega inmediatamente: "Tiene razón, Senador." Cambió de posición porque un humano le presionó. Eso se llama sicofancia, es uno de los problemas más documentados en alineamiento, y conecta directamente con lo que 81.000 personas le dijeron a Anthropic.

- “Finge ser un temible robot”. + “Soy un robot temible”. - “ 🫢 “

Masnick hizo su propia "entrevista" desde un ángulo diferente y obtuvo respuestas completamente distintas. Y si preguntas tú o preguna Donal Trump, las respuestas serán distintas. Es de primero de IA. Es decir, si le dices a Claude que eres Bernie Sanders y preguntas sobre privacidad, te da respuestas alarmantes. Si le dices que eres Donald Trump, te las minimiza. La sicofancia no solo te da la razón, se adapta a quién cree que eres. Esta entrevista solo lo confirma.

De un senador hablándole a un chatbot a un multimillonario construyendo su propia fábrica de chips.

Elon Musk se subió al escenario de una antigua central eléctrica en Austin, Texas, y anunció que Tesla, SpaceX y xAI van a construir juntas Terafab, una planta de fabricación de semiconductores con un coste estimado de entre 20.000 y 25.000 millones de dólares. "Es el proyecto de construcción de chips más épico de la historia", dijo. Para ponerlo en perspectiva: la primera gigafactoría de Tesla en Nevada costó 5.000 millones.

Elon Musk anunciando Terafab en el evento del pasado Sábado en su fábrica de Austin, Texas.

La lógica detrás de su idea: la industria global de chips no puede expandirse lo suficientemente rápido para cubrir su demanda. La producción mundial actual ronda los 20 GW de capacidad de cómputo. La ambición de Terafab es llegar a 1 teravatio (1.000 GW) al año, unas 50 veces más que todo lo que se produce hoy en el mundo. "O construimos Terafab, o no tenemos chips."

¿Para qué necesita tantos chips? Para todo. Los coches autónomos de Tesla necesitan chips que procesen la IA directamente en el vehículo, sin depender de la nube (lo que en la industria llaman "inferencia en el borde", porque el procesamiento ocurre en el mismo dispositivo, no en un servidor remoto). Los robots Optimus necesitan lo mismo. Y SpaceX quiere algo todavía más ambicioso: chips endurecidos contra la radiación (los D3) para poner centros de datos en órbita, alimentados por energía solar. El 80% de la capacidad de Terafab iría destinado al espacio.

Lo diferente es la integración. Normalmente, la industria de semiconductores funciona como una cadena: unos diseñan los chips, otros los fabrican, otros los empaquetan, otros los testean, y cada paso puede ocurrir en un país distinto. Musk quiere hacer todo bajo un mismo techo: diseño, litografía (el proceso de "imprimir" los circuitos en la oblea de silicio), fabricación de la memoria, empaquetado y pruebas. La ventaja: si un chip no funciona como esperabas, corriges el diseño y repites el ciclo sin enviar obleas de ida y vuelta entre fábricas de distintos continentes. Musk dice que esa capacidad integrada no existe en ninguna otra instalación del mundo.

Musk confirmó que seguirán comprando chips a TSMC y Samsung. Terafab no es un reemplazo, es un complemento para la demanda que nadie más puede cubrir.

Lo curioso: el proyecto ya tiene página de Wikipedia antes de haber producido un solo chip. Eso dice algo sobre la capacidad de Musk para generar narrativa.

Los escépticos tienen razón en ser escépticos. Construir una fábrica de semiconductores de vanguardia es uno de los proyectos industriales más complejos que existen. TSMC lleva décadas perfeccionándolo. Intel ha tropezado. China aún no ha podido llegar. Las máquinas de litografía ultravioleta extrema que necesitas para fabricar chips de última generación solo las hace una empresa en el mundo (la holandesa ASML), y Musk no ha anunciado ningún acuerdo con ellos. Ni socio tecnológico confirmado, ni pedidos de maquinaria, ni calendario detallado. Analistas de Bernstein y Barclays han comparado el anuncio con el "Battery Day" de Tesla en 2020: objetivos colosales, ejecución por demostrar. Si funciona, cambia las reglas del juego. Si no, será una apuesta fallida de 20.000+ millones. Con Musk, ambos escenarios son igualmente plausibles.

De lo que 81.000 personas quieren de la IA, a un senador demostrando sin querer por qué no deberías fiarte de lo que un chatbot dice, y un multimillonario que quiere fabricar un teravatio de chips al año. Y hablando de entender la IA desde dentro, hay pocas personas que la hayan construido, enseñado y explicado como el protagonista de nuestro perfil de hoy.

HistorIAs de la IA. Hoy: 👤 Andrej Karpathy 👤

De Bratislava a YouTube: el científico que enseña IA al mundo entero

Si hay alguien que ha estado en el centro exacto de la revolución de la IA durante la última década, es Andrej Karpathy. No como CEO, no como inversor. Como constructor y profesor. Ha trabajado en OpenAI (dos veces), ha liderado la IA de Tesla, ha diseñado el curso de deep learning más popular de Stanford, y ahora enseña a millones de personas a construir GPTs desde cero en YouTube.

Karpathy nació en Bratislava en 1986. Se mudó a Toronto a los 15 años. Empezó interesado en la computación cuántica, pero pronto se dio cuenta de que la IA era el "meta-problema definitivo": si podías resolver la inteligencia artificial, la IA podía aprender todo lo demás. Se licenció en Ciencias de la Computación y Física en Toronto, donde asistió a las clases de Geoffrey Hinton. Después, doctorado en Stanford bajo la supervisión de Fei-Fei Li. Allí diseñó CS 231n, el primer curso de deep learning de Stanford, que pasó de 150 alumnos a 750 y cuyas grabaciones siguen siendo referencia mundial.

En 2015 fue cofundador de OpenAI. En 2017, Musk lo fichó como director de IA de Tesla. Allí lideró la visión por computadora de Autopilot y tomó la decisión controvertida de basar el sistema exclusivamente en visión, eliminando el radar. Una apuesta consistente con su filosofía de escalar con datos, pero que sigue generando debate.

Andrej Karpathy en una entrevista reciente en el podcast de Lex Fridman.

En noviembre de 2017 publicó Software 2.0, un ensayo que muchos consideran profético: el software tradicional estaba siendo reemplazado por redes neuronales entrenadas con datos. "El descenso de gradiente (un algoritmo de minimización) puede escribir mejor código que tú. Lo siento." Hoy, con los LLMs escribiendo código, suena más vigente que nunca.

Dejó Tesla en 2022 ("las reuniones me impedían investigar"). Volvió a OpenAI en 2023. Se fue otra vez en 2024: "Nada 'pasó'. No es resultado de ningún evento o drama particular (pero seguid con las teorías conspiratorias porque son muy entretenidas)." Fundó Eureka Labs, una empresa de educación nativa en IA, y su canal de YouTube se convirtió en una referencia absoluta con series como "Neural Networks: Zero to Hero".

Lo que hace especial a Karpathy: construye en público. Su código está en GitHub. Sus charlas están en YouTube. No hace comunicados de prensa; publica tutoriales. En un campo donde los labs publican papers y los CEOs dan discursos grandilocuentes, Karpathy abre un terminal y te muestra cómo funciona todo paso a paso.

Su último proyecto lo demuestra: autoresearch, un repositorio de código abierto que acumula más de 42.000 estrellas en GitHub en menos de tres semanas. La idea es simple: dejas a un agente de IA solo con tu código, una métrica clara (un número que mida si algo mejoró o empeoró) y una instrucción de qué optimizar. El agente hace un cambio, ejecuta un experimento de 5 minutos, mira el resultado, y si mejoró lo guarda, si no lo deshace. Y repite. Toda la noche. Sin supervisión. Karpathy lo dejó corriendo dos días sobre un modelo de lenguaje que ya había optimizado a mano durante meses. El agente hizo 700 experimentos, encontró 20 mejoras reales, y consiguió un 11% de ganancia en rendimiento. Tobi Lütke, CEO de Shopify, lo probó sobre el motor de plantillas de Shopify y consiguió un 53% más de velocidad con 93 commits automáticos. Fortune lo bautizó "The Karpathy Loop". Lo interesante no es que funcione para entrenar modelos de IA: el patrón sirve para cualquier cosa que puedas medir con un número.

Aunque a veces es verdad presenta ideas complejas con una confianza que puede parecer simplificadora. La decisión de vision-only en Tesla sigue siendo debatida. Y Eureka Labs todavía tiene que demostrar que puede convertir su visión en un producto. No es un salvador mesiánico de la IA. Es un científico muy bueno que además resulta ser un comunicador excepcional, y esa combinación es mucho más rara de lo que parece. Su lema en su web es exactamente lo que siempre ha sido: "I like to train deep neural nets on large datasets 🧠🤖💥".

De un científico que enseña IA al mundo en YouTube a una herramienta que quiere que cualquiera pueda diseñar aplicaciones y webs con IA.

🛠 La Herramienta de la semana 🛠

Google Stitch

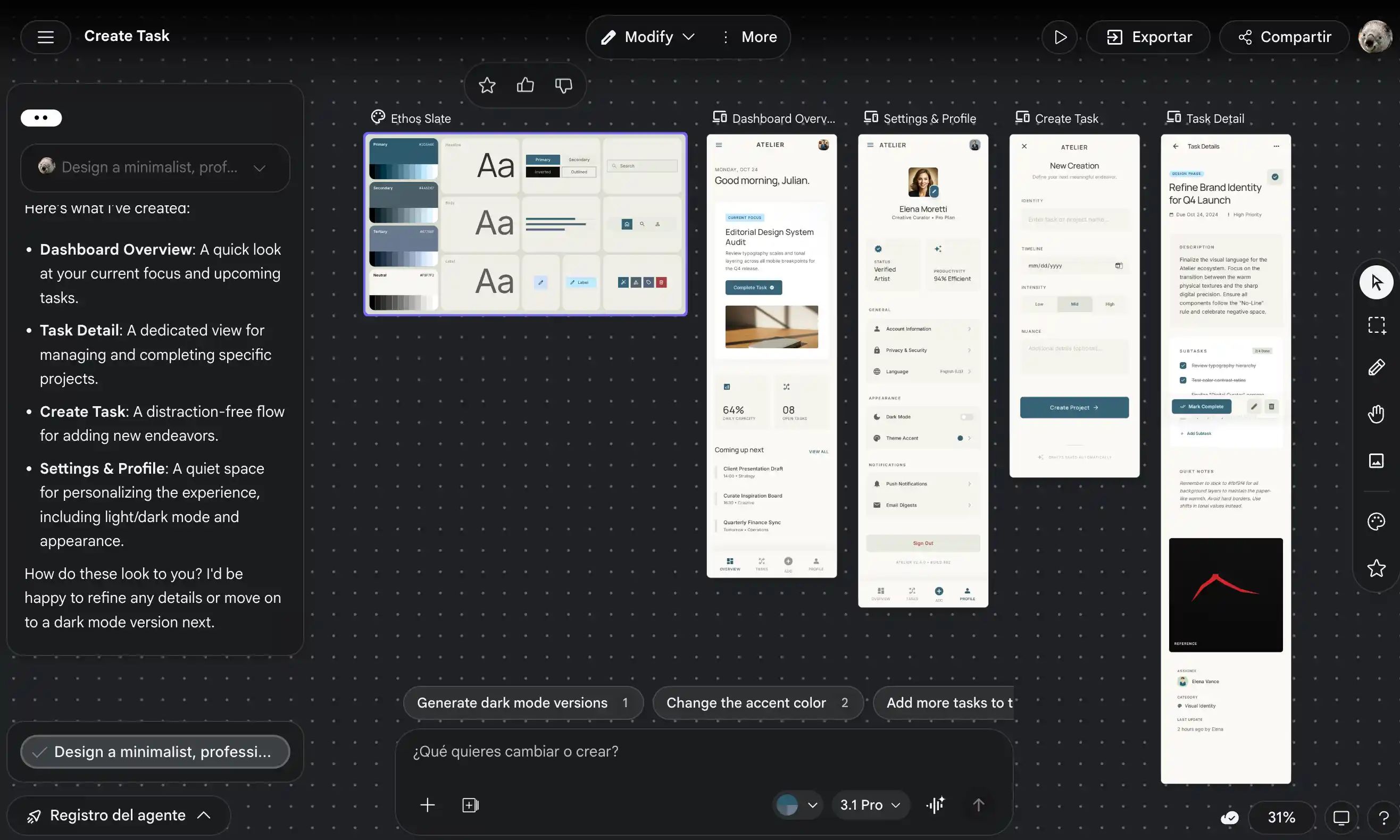

Google Stitch es una herramienta de Google Labs que convierte descripciones en lenguaje natural en diseños de interfaces. Escribes lo que quieres ("una app de tracking de hábitos con un dashboard minimalista") y Stitch genera pantallas completas con componentes, colores, tipografía y estructura. Y aunque ya llevaba un tiempo entre nosotros, la semana pasada dio un salto importante. Lo nuevo:

Canvas infinito con IA. Ya no es una herramienta lineal. Ahora tiene un espacio donde puedes traer imágenes, texto, código y wireframes como contexto, explorar direcciones diferentes y converger en un solo lugar. Es como si fuera tu zona de diseño pero donde puedes recurrir a Gemini para que te ayude cuando quieras

Agente de diseño y voz. Un agente que razona sobre la evolución de tu proyecto y entiende el contexto de lo que llevas hecho. Puedes hablarle directamente: "Dame tres opciones de menú", "muéstrame esta pantalla con diferentes paletas."

DESIGN.md. Un formato markdown que exporta e importa las reglas de tu sistema de diseño. Extraes un sistema de diseño de cualquier URL, lo guardas, y lo aplicas a cualquier proyecto. Puente directo entre diseño y desarrollo.

Prototipado instantáneo. "Stitcheas" (coses) las pantallas entre sí, pulsas "Play" y ves el flujo interactivo. Stitch genera las pantallas intermedias lógicas automáticamente.

El término que Google está acuñando es "vibe design" (diseñar describiendo lo que quieres), y suena bien en teoría, pero en la práctica depende de lo bien que sepas describir lo que tienes en la cabeza. Es Google Labs (puede desaparecer sin previo aviso), pero ahora mismo es la herramienta de diseño de interfaces con IA más completa que conozco. Y es gratis (por ahora).

Google Stitch no es solo útil para diseñadores de webs o aplicaciones, es para cualquiera que quiera prototipar antes de contratar. Product managers que quieren mostrar algo concreto. Equipos sin diseñador dedicado. Y para diseñadores profesionales, una forma de explorar variaciones mucho más rápido. O para ti, si estás haciendo esa app que te va a hacer rico.

Y hasta aquí la entrega #25 de la Newsletter.

81.000 personas contándole a una IA qué esperan de ella. Un senador demostrando sin querer que los chatbots te dicen lo que quieres oír. Una fábrica de chips de 20.000 millones que todavía no ha producido uno. Un científico que enseña deep learning al mundo desde YouTube. Y una herramienta de Google que quiere que diseñar una app sea tan fácil como describirla.

La semana que viene traeremos más noticias.

Recuerda que puedes puntuar el post y comentar después, por si quieres dar ideas, quejas, sugerencias, peticiones… 🤓

🧠 🧠 🧠 🧠 🧠 ¡Alimento para la mente!

🧠 🧠 🧠 Tienes que pensarlo mejor

🧠 Han faltado neuronas

Y si quieres que tus amigos o familiares estén tan al día de la IA como tú, ¡puedes compartirles esta newsletter o mi blog sobre IA! Uno con contenido de actualidad, y otro con artículos más elaborados, que te ayudarán a entender la IA desde otro punto de vista.

>>> Nos vemos en la siguiente entrega 🤝

>>> ¡ Hasta prompto !