Bienvenido al Prompt, la newsletter sobre Inteligencia Artificial escrita con un poco de Inteligencia Natural

¡Hola prompters! Aquí estamos de vuelta: 19 de Marzo de 2026. Newsletter número #24 ya.

Esta semana compensamos, porque las noticias se han acumulado y hay mucho que contar. La GTC de NVIDIA ha sido un no parar de anuncios, Mistral ha sacado de la manga una plataforma de entrenamiento para empresas, OpenAI parece estar replanteándose por dónde va su futuro, Yann LeCun ha levantado más de mil millones para su nueva startup, Anthropic ha lanzado una forma de controlar tu ordenador desde el móvil, y un tío ha salvado a su perro del cáncer usando IA. Sí, todo en dos semanas.

Hoy traemos más noticias de lo habitual y más cortas, sin sección de HistorIAs de la IA, pero con la Herramienta de la Semana que prometimos en la N23: Gamma. Que encima ha anunciado una nueva funcionalidad esta misma semana.

En la newsletter de hoy…

>>> Tres Seis noticias de la semana:

🟢 NVIDIA GTC 2026: Vera Rubin, NemoClaw, Nemotron Coalition y la apuesta total por la inferencia

🔵 Mistral Forge: entrenar modelos con tus propios datos (y de paso, Small 4 y Leanstral)

🔄 OpenAI cambia de hoja de ruta: menos distracciones, más código

🧪 Yann LeCun levanta 1.030 millones para AMI Labs y sus "modelos del mundo"

📱 Anthropic Dispatch: controla tu ordenador desde el móvil con Claude

🐕 Un perro salvado del cáncer gracias a AlphaFold y la IA

>>> 🛠 Herramienta de la semana 🛠 : Gamma.app

La prometimos en la entrega anterior, así que aquí está por fin: Gamma, la app que convierte un prompt en una presentación completa en menos de un minuto. Sin PowerPoint, sin plantillas, sin sufrimiento. Y el timing no podía ser mejor: precisamente esta semana han lanzado Gamma Imagine, su nueva funcionalidad de diseño nativo con IA. Os cuento al final.

Y cómo no, la canción de la semana la tenéis aquí:

¿Qué ha pasado esta semana en el mundo de la IA?

E

Esta semana ha sido la GPU Technology Conference (GTC) que organiza NVIDIA cada año. Como cada año, Jensen Huang salió al escenario del SAP Center y durante más de dos horas lanzó anuncio tras anuncio. Si prefieres verte un vídeo de dos horas con la presentación, aquí tienes el enlace, pero si no, vamos a intentar resumir lo importante sin que esto se convierta en un libro.

Lo grande: Vera Rubin. Es la nueva plataforma de computación de NVIDIA, una bestia compuesta por siete chips, cinco sistemas a escala de rack y un supercomputador.

No es solo una GPU nueva, es un sistema completo: CPU Vera, GPU Rubin, almacenamiento BlueField-4 STX, todo integrado verticalmente. Y lo que viene después ya tiene nombre: Feynman, con una nueva CPU llamada Rosa (por Rosalind Franklin). NVIDIA ya está diseñando dos generaciones por delante.

Lo que va a dar que hablar: Jensen dijo que ve "al menos 1 billón de dólares en ingresos de 2025 a 2027". Y presentó un gráfico que, según él, todos los CEOs deberían estudiar: lo único que importa es tokens por vatio. Más tokens por vatio = más ingresos.

Vera Rubin produce 5 veces más ingresos por gigavatio que Blackwell.

Lo agéntico: NemoClaw. Jensen llamó a OpenClaw "el proyecto open source más popular de la historia de la humanidad" y dijo que todas las empresas del mundo necesitan una estrategia de OpenClaw. NemoClaw es la capa de seguridad que NVIDIA pone encima: un stack open source que combina control de políticas, guardrails de red y enrutamiento de privacidad para que los agentes autónomos no hagan cosas que no deberían.

Peter Steinberger, el creador de OpenClaw, estaba en la GTC y la gente hacía cola para hablar con él.

Lo abierto: Nemotron Coalition. Una alianza con Mistral, Cursor, Perplexity, Black Forest Labs y otros para construir modelos frontier abiertos. Seis familias de modelos: Nemotron (lenguaje y razonamiento), Cosmos (mundo y visión), Isaac GR00T (robótica), Alpaymayo (conducción autónoma), BioNeMo (biología) y Earth-2 (clima).

Y para cerrar, el DGX Station (el primer supercomputador de escritorio) ya se está entregando. El primero lo recibió Andrej Karpathy. 748 GB de memoria coherente, hasta 20 petaflops, y la posibilidad de ejecutar modelos de hasta un billón de parámetros desde tu mesa.

Y antes de irse del escenario, Jensen tuvo tiempo para una cosa más: presentó a Olaf. El muñeco de nieve de Frozen apareció caminando, hablando e interactuando con él en directo, como resultado de la colaboración entre NVIDIA, Disney Research y DeepMind. La tecnología detrás es Newton, el motor de física open source de NVIDIA, que permite dar vida física a personajes animados con movimiento real.

Olaf tendrá su gran debut el 29 de marzo en la inauguración de World of Frozen en Disneyland París. Es una noticia de robótica envuelta en papel de regalo Disney, pero deja claro hasta dónde ha llegado la simulación física con IA.

La GTC dejó claro una cosa: NVIDIA ya no vende GPUs. Vende la infraestructura completa de la economía de la IA, desde el escritorio hasta el espacio (sí, literalmente: anunciaron que van a poner Vera Rubin en órbita).

Y hablando de empresas que quieren darte las herramientas para construir tu propia IA, Mistral ha tenido una semana muy productiva.

🔵 Mistral Forge: entrena tu propio modelo frontier con tus datos

Novedades de los franceses. Mistral ha anunciado Forge, una plataforma para que las empresas puedan entrenar modelos frontier con sus propios datos. La idea es sencilla: los modelos de IA genéricos están entrenados con datos públicos, pero las empresas operan con conocimiento interno (manuales, código propietario, normativas, procesos). Forge permite que ese conocimiento se integre directamente en el modelo.

Forge soporta preentrenamiento, postentrenamiento y aprendizaje por refuerzo, tanto con arquitecturas densas como Mixture of Experts. Y lo más llamativo: está pensado para que los propios agentes de IA (como Mistral Vibe) puedan usarlo, no solo humanos. Un agente puede lanzar un fine-tuning, buscar hiperparámetros óptimos, generar datos sintéticos y monitorizar métricas de forma autónoma. ASML, la Agencia Espacial Europea, Ericsson y Samsung ya están entre los primeros usuarios.

Y de paso, Mistral también ha sacado Small 4, su nuevo modelo estrella: 119B parámetros totales pero solo 6B activos por token (Mixture of Experts con 128 expertos, 4 activos por token). Unifica lo que antes eran tres modelos separados: Magistral (razonamiento), Pixtral (multimodal) y Devstral (código agéntico). Contexto de 256K tokens, multimodal nativo, y un parámetro de "esfuerzo de razonamiento" que puedes configurar según la tarea. Open source con Apache 2.0 y miembro fundador de la Nemotron Coalition de NVIDIA. Los benchmarks son competitivos contra GPT-OSS 120B con respuestas más cortas (menos tokens, menos coste).

Y para los más técnicos: Leanstral, el primer agente de código open source para Lean 4, un asistente de pruebas matemáticas. Puede verificar formalmente las implementaciones contra especificaciones estrictas. Con 6B parámetros activos, consigue resultados comparables a Claude Sonnet pero a una fracción del coste ($36 vs $549). Muy nicho, pero muy relevante para quienes trabajan en verificación formal de software.

Con Forge, Mistral está dando mucha más flexibilidad y opciones, más allá de simplemente permitir un pequeño ajuste fino de sus modelos.

Mientras Mistral construye herramientas para que otros entrenen modelos, en OpenAI parece que están replanteándose qué deberían construir ellos mismos.

Según el Wall Street Journal, los ejecutivos de OpenAI están finalizando un cambio de estrategia importante para reenfocarse en código y usuarios de empresa. Fidji Simo, la CEO de aplicaciones de OpenAI, lo dejó claro en una reunión interna: "No podemos perder este momento porque estamos distraídos con side quests (misiones secundarias). Tenemos que clavar la productividad, en general, y particularmente la productividad en el frente empresarial".

El diagnóstico es revelador. El año pasado, OpenAI lanzó Sora (generación de vídeo), Atlas (navegador web), un dispositivo de hardware y funciones de e-commerce para ChatGPT. Sam Altman lo comparó con "apostar en una serie de startups" dentro de OpenAI. El resultado: Sora llegó al número 1 del App Store cuando lanzó su app independiente en septiembre, pero el uso se estancó en los meses siguientes. Ahora planean integrar la generación de vídeo directamente en ChatGPT.

Fidji Simo, CEO de aplicaciones de OpenAI, ha sido quien ha revelado el reciente cambio de estrategia.

Mientras tanto, Anthropic les ha adelantado en el segmento de código y empresa. Claude Code y Cowork se han convertido en las herramientas de referencia para desarrolladores. Y sobre esto Simo dijo a los empleados que el éxito de Anthropic debería ser un "wake-up call" para OpenAI.

Empleados actuales y antiguos describen al WSJ una situación donde la estrategia de "hacer todo a la vez" dio lugar a falta de foco, recursos de computación que saltaban de un equipo a otro a última hora, y una estructura organizativa cada vez más complicada. Simo está empujando para integrar más los equipos de investigación y producto, y unificar las apuestas a largo plazo (incluido el dispositivo de hardware) alrededor de mejorar la productividad del usuario.

OpenAI ha recuperado algo de terreno en código: Codex tiene ahora más de dos millones de usuarios activos semanales, casi cuatro veces más que a principios de año. Pero Simo fue clara sobre la urgencia: "Estamos actuando como si fuera un código rojo" al igual que hicieron a finales de 2025 cuando vieron que Google con Gemini 3 les adelantaba por la derecha.

Tanto OpenAI como Anthropic se dirigen hacia posibles salidas a bolsa que podrían producirse este año, lo que añade todavía más presión a la competición. De momento, OpenAI también se beneficia de su dominio en el mercado de consumo y de la designación de Anthropic como "riesgo para la cadena de suministro" por el Pentágono, que ha hecho que algunas empresas sean más cautelosas a la hora de comprar tecnología de Anthropic.

De una empresa que busca su foco a un científico que acaba de confirmar el suyo.🧪 Yann LeCun levanta 1.030 millones para AMI Labs

¿Os acordáis de Yann LeCun? Le dedicamos un perfil completo hace unos meses ya, cuando anunció que dejaba Meta después de más de una década liderando FAIR. Pues su nueva startup, AMI Labs, acaba de cerrar una ronda de 1.030 millones de dólares con una valoración de 3.500 millones. No está mal para alguien que todavía no tiene producto.

AMI Labs trabaja en "modelos del mundo" (world models): IA que aprende de la realidad, no solo del lenguaje. Es la obsesión de LeCun desde hace años: modelos con arquitectura JEPA (Joint Embedding Predictive Architecture) que puedan entender el mundo físico, no solo generar texto. Si los LLMs aprenden de leer, los world models aprenden de observar.

El equipo es impresionante: LeCun como presidente, Alexandre LeBrun (exCEO de Nabla) como CEO, Laurent Solly (ex-VP de Meta Europa) como COO, y varios investigadores de primer nivel. Sede en París, con oficinas en Nueva York, Montreal y Singapur. Entre los inversores están NVIDIA, Samsung, Toyota, Bezos Expeditions, Eric Schmidt y Tim Berners-Lee. Y están buscando más gente que se les una al proyecto, por si te ves trabajando para ellos.

LeBrun reconoce que esto no va a dar resultados inmediatos. "No es tu típica startup de IA aplicada que puede sacar un producto en tres meses y facturar en seis", dijo a TechCrunch. Su predicción: "En seis meses, todas las empresas se llamarán a sí mismas 'empresa de world models' para levantar rondas". Es el siguiente buzzword.

Yann LeCun, fundador de AMI Labs. ¿Conseguirán que los ‘world models’ sean la nueva revolución tras los LLM?

Lo que parece más interesante es cómo la salida de LeCun de Meta se ha materializado exactamente como ya se veía venir: un proyecto ambicioso, con mucho capital, y con un enfoque radicalmente distinto al mainstream de los LLMs. Pero habrá que ver el recorrido. Si tiene éxito, podría cambiar la dirección de toda la industria. Si no, habrá sido el experimento de mil millones más caro de la historia (en realidad hay varios a este nivel, en estos años de locura de la IA). De momento, publicarán papers y harán código open source. Consistente con el LeCun que conocemos.

Mientras LeCun busca reimaginar la IA desde cero, Anthropic sigue añadiendo funcionalidades a la que ya tiene. Y la última es bastante llamativa.

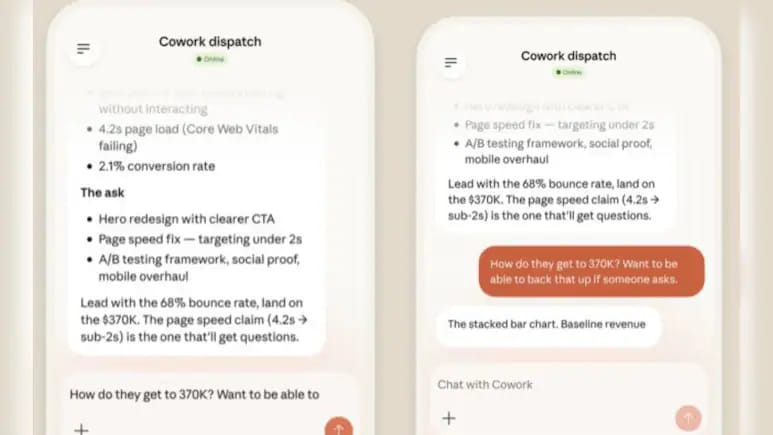

Anthropic ha sacado en research preview Dispatch, una nueva funcionalidad de Cowork que permite asignar tareas a Claude desde tu teléfono para que las ejecute en tu ordenador. La idea: un hilo único de conversación persistente que sincroniza entre móvil y escritorio. Le mandas un mensaje desde el móvil, Claude trabaja en tu ordenador (con acceso a tus archivos, conectores y plugins de Cowork), y te manda el resultado cuando terminas.

Puedes pedirle que extraiga datos de una hoja de cálculo local, busque en tus mensajes de Slack y correo para redactar un informe, cree una presentación con archivos de Google Drive, u organice archivos en una carpeta de tu ordenador. Todo sin estar delante de la pantalla. Felix Rieseberg, el ingeniero de Anthropic que lo anunció en X, lo describió como "mágico": "Todo lo que Claude puede hacer en tu ordenador (archivos, navegador, herramientas) se vuelve accesible desde donde estés".

Capturas de pantalla de lo que muestran en el vídeo de presentación que enseñó Felix Rieseberg, del equipo de Anthropic, en un post en X. No hay mucho que enseñar. puedes mandar comandos ahora desde el móvil.

Detalles importantes: Claude ejecuta todo en un sandbox en tu propio dispositivo y pide aprobación antes de tomar cualquier acción. Los archivos son locales, no suben a ningún servidor. Las limitaciones de siempre: el ordenador tiene que estar encendido y con Claude Desktop abierto. De momento un solo hilo de conversación, sin paralelos. Disponible primero para planes Max; Pro llegará pronto.

NemoClaw de NVIDIA, Dispatch de Anthropic, OpenClaw creciendo... el tema de fondo es el mismo: los agentes de IA están dejando de ser chatbots para convertirse en asistentes que actúan por ti. Y a veces, esa acción salva vidas. Literalmente.

Y para cerrar las noticias, una historia que quizá os haga mirar a la IA con otros ojos.

Paul Conyngham es un empresario tecnológico australiano. En 2019 adoptó a Rosie, una mestiza de ocho años. En 2024, a Rosie le diagnosticaron cáncer de mastocitos, un tumor potencialmente fatal. La cirugía y la quimioterapia estándar no funcionaron. Y Conyngham decidió buscar otra salida.

Primero usó ChatGPT para orientarse sobre opciones. El modelo le recomendó contactar con el Centro Ramaciotti de Genómica de la Universidad de Nueva Gales del Sur (UNSW). Conyngham pagó 3.000 dólares de su bolsillo para secuenciar el ADN del tumor de Rosie. Con esa secuencia, usó AlphaFold (el sistema de DeepMind que predice estructuras 3D de proteínas) para modelar la proteína c-KIT, que es la que impulsa el cáncer de mastocitos en perros. Identificó un fármaco que podría atacarla. Pero el fabricante se negó a proporcionarlo para uso compasivo en un animal.

Segunda vuelta. Conyngham trabajó con investigadores del UNSW para diseñar una vacuna mRNA personalizada hecha directamente del tumor de Rosie, usando Grok para diseñar el constructo final. La vacuna se fabricó en el laboratorio de la universidad. Pero entonces llegó el siguiente obstáculo: necesitaba un veterinario con aprobación ética para administrarla. Mari Maeda, de la Canine Cancer Alliance en Seattle, le puso en contacto con Rachel Allavena, de la Universidad de Queensland. La vacuna viajó hasta Gatton, un pueblo rural a las afueras de Brisbane. Conyngham hizo diez horas de coche con Rosie para la primera inyección en diciembre. Refuerzo en febrero. Resultado: un tumor del tamaño de una pelota de tenis en la pata trasera se ha reducido a la mitad.

"No me hago ilusiones de que esto sea una cura", dijo Conyngham. "Pero creo que este tratamiento le ha dado a Rosie significativamente más tiempo y calidad de vida." Ahora está trabajando en una segunda vacuna para otro tumor que no respondió al primer tratamiento.

Paul Conyngham con su perro Rosie

El detalle que lo cambia todo: Conyngham solo pagó 3.000 dólares, la secuenciación del ADN. El resto lo hicieron investigadores que donaron su tiempo y recursos. Sin eso, producir nanopartículas de mRNA cuesta alrededor de 100.000 dólares por paciente. No es un proceso que cualquiera pueda replicar mañana.

Pero lo que la historia ilustra sí es nuevo. Hace cinco años, ni siquiera sabías por dónde empezar. Hoy, una persona con determinación y acceso a herramientas de IA puede secuenciar, modelar proteínas, identificar dianas terapéuticas y diseñar una vacuna personalizada. El conocimiento científico ya no está solo en los laboratorios. La distancia entre "persona con una idea" y "persona que puede ejecutar esa idea" se está reduciendo. Y eso, para bien y para mal, va a cambiar muchas cosas.

NVIDIA no para, modelos que entrenan con tus propios datos, hojas de ruta que se reescriben, startups de mil millones, agentes que controlan tu ordenador desde el móvil, y perros que le deben la vida a la IA. Semana intensa. Pero faltaba algo: la herramienta que prometimos hace dos entregas.

🛠 La Herramienta de la semana 🛠

Gamma.app , para hacer presentaciones powerpoint con un prompt

Gamma es la app que convierte un prompt en una presentación completa en menos de un minuto. No es una metáfora: le describes el tema, eliges cuántas secciones quieres y el estilo visual, y en unos clics tienes slides con texto, imágenes y gráficos generados. Sin abrir PowerPoint. Sin pelearte con plantillas. Sin ese momento de terror delante de una diapositiva en blanco.

La velocidad es lo primero que sorprende, pero lo que engancha es el nivel del punto de partida. La primera versión que genera suele ser presentable sin tocar nada. Hay un chat integrado para ajustar en lenguaje natural ("pon esto más visual", "acorta el texto de esta slide"). Puedes cambiar el tema visual completo con un clic, sin afectar el contenido. Los gráficos más comunes (embudos, timelines, diagramas de Gantt) se generan solos y se puede integrar con YouTube, Figma, Miro, Google Drive, Loom, Unsplash...

El problema es que el "look Gamma" se empieza a reconocer. Igual que pasó con Canva, o con NotebookLM (ya llegaremos a esta otro día) después de ver unas cuantas presentaciones hechas con esta app, el cerebro la identifica a los tres segundos. Si necesitas control fino sobre tipografía, colores de marca o posicionamiento exacto, te vas a frustrar: la personalización profunda no es su fuerte. Las imágenes que genera la IA varían mucho en calidad. Y al exportar a PowerPoint o Google Slides, el formateo a veces se descuadra. Funciona solo con internet, sin excepción.

Ah, y hace apenas unas semanas Gamma ha lanzado Gamma Imagine, su nueva apuesta por el diseño nativo con IA. Va directamente al punto débil más criticado: el control visual. Es pronto para ver hasta dónde llega, pero el timing no podía ser mejor.

Precios: plan gratis con 400 créditos que no se renuevan, Plus a 8€/mes, Pro a 18€/mes. Truco: si invitas a alguien, os dan 200 créditos extra a ambos. Y sobre el uso: el formato "flexible card" (el predeterminado) queda mejor que el 16:9 clásico. Y si quieres resultados de nivel, genera primero un guion detallado con Claude o ChatGPT y pásaselo a Gamma. El combo funciona sorprendentemente bien.

Mi veredicto: la mejor herramienta de presentaciones con IA que he probado, con diferencia. Para generar una primera versión sólida en segundos, no tiene competencia real. Las limitaciones son reales pero asumibles. Y si Gamma Imagine acaba resolviendo el problema de la personalización visual, la ventaja sobre el resto se agranda todavía más.

Y hasta aquí la entrega #24 de la Newsletter.

Dos semanas de noticias condensadas en una. La GTC ha dejado claro que NVIDIA quiere ser la empresa de infraestructura de la IA, no solo el fabricante de chips. LeCun apuesta mil millones a que los LLMs no son el futuro. Mistral demuestra que los franceses siguen muy vivos. Y mientras tanto, un perro en Australia le debe la vida a la inteligencia artificial. La semana que viene, más, como siempre.

Recuerda que puedes puntuar el post y comentar después, por si quieres dar ideas, quejas, sugerencias, peticiones… 🤓

🧠 🧠 🧠 🧠 🧠 ¡Alimento para la mente!

🧠 🧠 🧠 Tienes que pensarlo mejor

🧠 Han faltado neuronas

Y si quieres que tus amigos o familiares estén tan al día de la IA como tú, ¡puedes compartirles esta newsletter o mi blog sobre IA! Uno con contenido de actualidad, y otro con artículos más elaborados, que te ayudarán a entender la IA desde otro punto de vista.

>>> Nos vemos en la siguiente entrega 🤝

>>> ¡ Hasta prompto !