Bienvenido al Prompt, la newsletter sobre Inteligencia Artificial escrita con un poco de Inteligencia Natural

¡Hola prompters! Aquí estamos otra semana más: 5 de Marzo de 2026. Primera Newsletter de Marzo, la número #23.

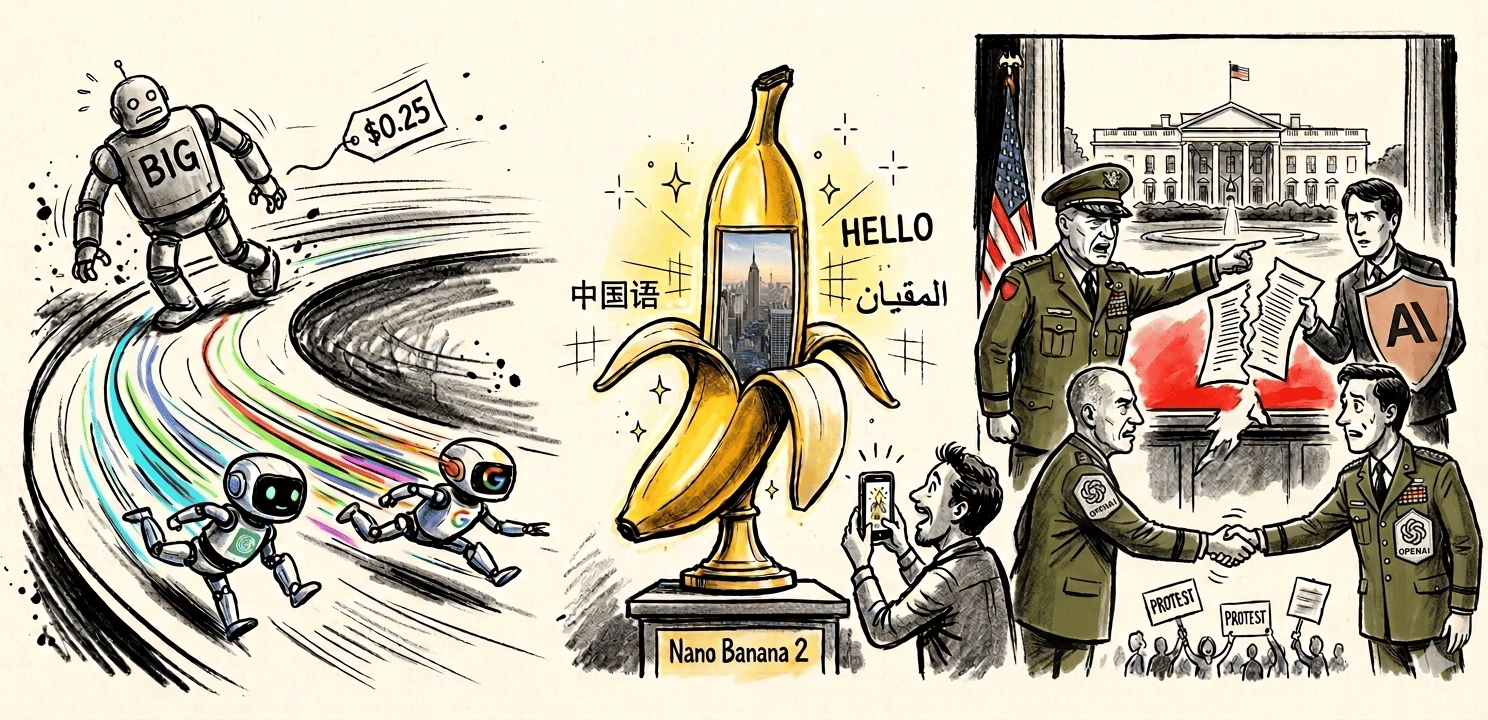

Esta semana la IA ha decidido que más grande no siempre es mejor. Tres grandes labs han sacado modelos pequeños y rápidos al mismo tiempo, como si se hubieran puesto de acuerdo para demostrar que la inferencia barata es el nuevo campo de batalla. También llega por fin Nano Banana 2 (que os prometimos la semana pasada 🍌), y la saga del Pentágono contra Anthropic ha dado un giro que nadie esperaba: designación de "riesgo para la cadena de suministro", un tuit presidencial en mayúsculas, OpenAI firmando un acuerdo con el Departamento de Guerra, y desinstalaciones masivas de ChatGPT. Sí, todo en la misma semana.

Vamos con un resumen rápido y al grano, que hay tela que cortar.

En la newsletter de hoy…

>>> Tres noticias de la semana:

⚡ Modelos pequeños, rápidos y baratos: GPT-5.3 Instant, Gemini 3.1 Flash Lite y Qwen 3.5 Small

🍌 Nano Banana 2: imágenes en 4K con texto perfecto y personajes consistentes

🏛️ Anthropic vs. el Pentágono (Parte II): "riesgo para la cadena de suministro", Trump enfurecido, y OpenAI entra en escena

Además, en HistorIAs de la IA hoy hablamos de Palmer Luckey, el joven que creó Oculus con 19 años, lo vendió a Facebook por 2.000 millones, fue despedido por apoyar a Trump, y fundó Anduril, la empresa de armas autónomas con IA que hoy es protagonista central del debate Pentágono-Silicon Valley. Esta semana la newsletter ya venía cargada, así que la Herramienta de la Semana se queda para la próxima entrega: hablamos de Gamma, la app que convierte un prompt en una presentación completa en segundos.

Y la canción de la semana nos va a resumir las líneas rojas que ha puesto Anthropic, en un tono muy bélico.

¿Qué ha pasado esta semana en el mundo de la IA?

⚡ La IA se hace pequeña: tres modelos rápidos y baratos en la misma semana

Si las semanas pasadas hablábamos de modelos que compiten por ser los más inteligentes (Gemini 3.1 Pro, Claude Opus 4.6…), esta semana el foco ha cambiado: se trata de quién es más rápido, más barato y más ligero. Tres grandes labs han lanzado modelos pequeños prácticamente a la vez, y el mensaje esta vez apunta al otro extremo: la IA del día a día no necesita un modelo que piense durante 30 segundos.

GPT-5.3 Instant de OpenAI es el que más ha dado que hablar. No es un modelo de razonamiento; es lo que OpenAI describe como un modelo que "responde antes de que termines de parpadear". Todo gira alrededor de la velocidad y la latencia baja: está pensado para conversaciones rápidas, búsqueda web con síntesis, y respuestas directas. OpenAI presume de que ha reducido las alucinaciones un 26,8% en búsqueda web y un 22,5% según informes de usuarios, y que ha mejorado las "negaciones falsas" (menos respuestas tipo "lo siento, no puedo ayudarte con eso" cuando sí puede). El tono también ha cambiado: menos robótico, más natural. A $1,75 por millón de tokens de entrada y $14 por millón de salida, no es el más barato de la lista, pero es velocidad lo que vende, y ahí está bien posicionado. ¿Limitaciones? Ellos saben que otros idiomas como japonés o coreano suenan más rígidos. Se nota que lo han optimizado para el inglés.

Gemini 3.1 Flash Lite de Google va por otro camino: es un modelo de razonamiento escalable para tareas de alto volumen. Lo interesante es que piensa (tiene "scalable thinking") pero a un precio que no duele: $0,25 por millón de tokens de entrada, $1,50 de salida. Y es rápido: 363 tokens por segundo. Y como acostumbra Gemini, mucho contexto (un millón de tokens) y multimodal.

Los benchmarks son sólidos para un modelo de este tamaño: 86,9% en GPQA Diamond, 88,9% en MMMLU. La idea de Google es que tengas un modelo que razone, pero que puedas usar en producción a escala sin arruinarte.

Y luego está Qwen 3.5 Small models, de Alibaba, que va un paso más allá: modelos de 0,8B a 9B parámetros que puedes ejecutar en tu teléfono o en tu portátil. Sin internet, sin API, sin coste por token. El modelo de 4B es multimodal nativo (texto e imagen), y el de 9B usa Scaled RL para razonamiento, compitiendo con modelos 5 a 10 veces más grandes. Para tener un modelo local que funcione sin depender de nadie, la familia Qwen 3.5 Small es la apuesta más interesante.

Está claro que todas las grandes compaías se siguen muy de cerca, y casi nunca suele haber un anuncio de este tipo aislado. A los pocos días de sacar un modelo del tipo que sea, ya está la competencia anunciando el que tenían ellso en el cajón. Y no solo se trata de quién tiene el modelo más listo. A veces el futuro de la IA del día a día no está en el modelo que piensa mejor, sino en el que piensa lo suficientemente bien, lo suficientemente rápido, y lo suficientemente barato.

Y hablando de "lo suficientemente bueno y rápido", la semana pasada os dijimos que Nano Banana 2 acababa de salir y que traeríamos más detalles. Pues aquí están.

La semana pasada os lo adelantamos como noticia de última hora y prometimos dedicarle más espacio en esta publicación. Aquí va.

Nano Banana 2 (que técnicamente se llama Gemini 3.1 Flash Image, pero nadie lo llama así) combina la calidad del Nano Banana Pro con la velocidad del modelo Flash. Desde que Google lanzó el primer Nano Banana en noviembre, se ha usado más de 20 millones de veces. Y la versión 2 mejora prácticamente en todo.

Lo más destacado:

- Texto en imágenes: si alguna vez habéis intentado que un generador de imágenes escriba bien un texto, sabéis que es un calvario. Nano Banana 2 hace renderizado preciso de texto, incluyendo traducciones a múltiples idiomas. Puedes pedirle un cartel en español y que el texto salga bien escrito.

- Conocimiento del mundo real: el modelo tira de la base de conocimiento de Gemini y de búsqueda web en tiempo real. Si le pides una imagen de un edificio real, sabe cómo es.

- Consistencia de personajes: hasta 5 personajes y 14 objetos consistentes en una misma sesión de generación. Ideal para storyboards, cómics o presentaciones donde necesitas que el mismo personaje aparezca en varias imágenes.

- Resolución: de 512px hasta 4K, con múltiples relaciones de aspecto.

- Iluminación y texturas: Google ha mejorado lo que llaman "vibrant lighting" y las texturas son notablemente más realistas.

Texto en imágenes muy conseguido, cada vez te encontrarás menos fallos cuando le pides que añada el texto que quieras. Compara esto con hace apenas unos mesees…

Nano Banana 2 ya es el modelo por defecto en la app de Gemini (en los modos Fast, Thinking y Pro), en Google Search (disponible en 141 países), en AI Studio y en Vertex AI. Todas las imágenes llevan marca de agua SynthID y credenciales C2PA de Content Credentials.

La consistencia de personajes también es muy buena y no es desdeñable. Si queires hacer un set de imágenes, con Nano Banana 2, podrás.

Para los que usan generadores de imágenes regularmente: la combinación de velocidad Flash con calidad Pro, más el renderizado de texto y la consistencia de personajes, hace que Nano Banana 2 sea posiblemente la opción más completa ahora mismo si no necesitas la calidad artística de Midjourney.

De modelos que generan imágenes a modelos que generan controversia. Porque la saga del Pentágono contra Anthropic ha escalado esta semana a niveles que no esperábamos.

🏛️ Anthropic vs. el Pentágono (Parte II): "riesgo para la cadena de suministro", Trump enfurecido, y OpenAI entre medias

La semana pasada os contamos que el Pentágono había dado un ultimátum a Anthropic. Esta semana, ya conocemos el desenlace. Y no, no se han calmado las aguas. La situación ha escalado de forma dramática.

Lo que ha pasado, paso a paso:

El 26 de febrero, Dario Amodei publicó un comunicado extenso explicando la posición de Anthropic. Lo más relevante: Anthropic dice que cree "profundamente en la importancia existencial de usar la IA para defender Estados Unidos y otras democracias". Recuerda que fueron los primeros en desplegar modelos en redes clasificadas del gobierno, los primeros en los Laboratorios Nacionales, y los primeros en ofrecer modelos personalizados para seguridad nacional. Claude ya se usa extensivamente en análisis de inteligencia, planificación operativa, ciberoperaciones y más.

Pero hay dos líneas que Anthropic dice que no va a cruzar: vigilancia masiva de ciudadanos estadounidenses y armas totalmente autónomas (sin humano en el bucle). Aunque es cuanto menos curioso que el argumento de Amodei por el que no está a favor del uso de armas autónomas es que la IA actual "simplemente no es lo suficientemente fiable como para alimentar armas totalmente autónomas". En cuanto a la IA para vigilancia masiva doméstica dice que "es incompatible con los valores democráticos". Ofreció al Departamento de Defensa trabajar juntos en I+D para mejorar la fiabilidad de estos sistemas, pero el Pentágono no ha aceptado esa oferta.

El 27 de febrero, Pete Hegseth, secretario de Defensa, designó oficialmente a Anthropic como "riesgo para la cadena de suministro". Anthropic respondió diciendo que esa etiqueta "históricamente estaba reservada para adversarios de Estados Unidos, y nunca se había aplicado públicamente a una empresa estadounidense". Han dicho que lo impugnarán en los tribunales. Amodei fue claro en la BBC: "Prefiero no trabajar con el Pentágono que acceder a usos que puedan socavar los valores democráticos."

Mientras tanto, OpenAI entra en escena.

El 28 de febrero, Sam Altman anunció que OpenAI había llegado a un acuerdo con el Departamento de Guerra. El acuerdo supuestamente establece tres líneas rojas que también Anthropic intentó marcar: no vigilancia masiva doméstica, no armas autónomas, y no decisiones automatizadas de alto riesgo. Despliegue solo en la nube, con la pila de seguridad de OpenAI intacta y personal autorizado de OpenAI en el bucle. La referencia explicita a la Cuarta Enmienda y la exclusión de la NSA del contrato son detalles que no se suelen ver en acuerdos con el Departamento de Defensa.

Altman pidió al Departamento de Guerra que ofrezca los mismos términos a todos los laboratorios de IA. Y dijo públicamente que Anthropic no debería ser designada como "riesgo para la cadena de suministro". Pero entonces ¿por qué unos son los malos y con otros se alcanza un acuerdo? Tiene que haber detalles en el acuerdo que no han llegado al público.

Y entonces llegó Trump.

El presidente publicó un mensaje en su red social en mayúsculas ordenando a "TODAS las agencias federales" cesar "INMEDIATAMENTE" el uso de tecnología de Anthropic, con un plazo de 6 meses para eliminarla por completo, amenazando con "el Poder Total de la Presidencia" y "graves consecuencias civiles y penales" para quien no cumpliera. Emil Michael, subsecretario de Defensa, también atacó personalmente a Amodei en X. Un antiguo funcionario del Departamento de Defensa calificó los motivos de Hegseth como "extremadamente endebles".

La respuesta de la gente: las cancelaciones de ChatGPT se dispararon un 295% después de que OpenAI firmara el acuerdo con el Departamento de Guerra. Para una parte del público, si tu lab de IA favorito trabaja con el Pentágono, deja de ser tu lab favorito. Para otra parte, negarse a colaborar con la defensa nacional es irresponsable. No hay consenso fácil aquí.

Un detalle más que hace la historia todavía más compleja: según la BBC, Claude fue utilizado en una operación en Venezuela contra Maduro. Es decir, Anthropic ya estaba colaborando con operaciones de inteligencia, solo que las líneas rojas que mantienen son específicamente la vigilancia masiva doméstica y las armas sin control humano.

En medio de todo esto, trabajadores del sector tecnológico (incluyendo trabajadores de Deepmind y la propia OpenAI) publicaron una carta abierta pidiendo al Departamento de Defensa y al Congreso que retiren la designación de Anthropic como "riesgo para la cadena de suministro". La comunidad de IA está dividida como nunca.

Ya que tenemos este tremendo lío de fechas y sucesos y acaba de salir Nano Banana 2 que es tan bueno en texto supuestamente, he querido probar sus capacidades. Simplemente ha copiado/pegado el texto de esta sección en Gemini y he pedido un esquema. No he tocado nada. Habrá alguna errata, alguna decisión de estilo discutible y la leyenda esta no pinta mucho. Pero en general ni tan mal, para haberlo hecho en segundos, ¿no?

Modelos que se hacen pequeños y rápidos, imágenes que por fin renderizan texto bien, y una saga geopolítica que podría ser un guion de serie. Esta semana no ha sido solo tecnología, también política, defensa, ideología…. Y hablando de personas en la intersección exacta entre tecnología y defensa: hay un personaje que lleva años en ese cruce y cuya historia viene muy a cuento estos días de guerra.

HistorIAs de la IA. Hoy: 👤 Palmer Luckey 👤

De la realidad virtual a las armas autónomas: el fundador más polémico de Silicon Valley

Si alguien personifica la tensión entre Silicon Valley y el Pentágono que domina las noticias esta semana, es Palmer Luckey. Pero no porque se parezca a Darío Amodei en espíritu, precisamente.

Un chaval que con 17 años construyó el primer prototipo de Oculus Rift en el garaje de sus padres en Long Beach, California. A los 19, fundó Oculus VR. A los 21, lo vendió a Facebook por 2.000 millones de dólares.

La historia empieza como tantas en Silicon Valley: un adolescente obsesionado con la tecnología. Luckey no fue a una universidad de élite (de hecho, nunca terminó la carrera). Fue educado en casa por su madre, empezó a tomar cursos en community colleges a los 14 años, y financiaba sus proyectos reparando y revendiendo iPhones rotos. Sus hobbies incluían construir cañones de gauss y bobinas de Tesla, con varios accidentes serios de por medio. También tenía un PC gaming que valía decenas de miles de dólares con seis monitores. Hasta aquí todo normal.

Un jovencísimo Palmer con sus Oculus cuando empezó a desarrollarlas

Lo que hizo diferente fue ver lo que la industria no veía. En 2009, los cascos de realidad virtual existentes eran caros, pesados, con campo de visión estrecho y latencia alta. Nadie apostaba por la VR. Luckey construyó más de 50 prototipos, compartiendo su progreso en foros especializados. Cuando John Carmack (el legendario programador de Doom y Quake) le pidió un prototipo prestado y lo mostró en el E3 2012, miles de personas se interesaron de golpe. Luckey dejó la universidad, lanzó una campaña de Kickstarter para el Oculus Rift que recaudó 2,4 millones de dólares (un 974% de su objetivo), y con el respaldo de Gabe Newell (fundador de Valve) y otros pesos pesados de los videojuegos, la realidad virtual volvió de entre los muertos. Dos años después, Facebook pagó 2.000 millones por Oculus.

Hasta aquí todo bien. Pero en septiembre de 2016, se descubrió que Luckey había donado 10.000 dólares a un grupo pro-Trump. Las consecuencias: varios desarrolladores cancelaron su soporte a Oculus, la prensa lo crucificó, y Facebook (según documentos internos del Wall Street Journal) presionó a Luckey para que declarara públicamente su apoyo al candidato libertario Gary Johnson en lugar de a Trump. En marzo de 2017, fue despedido. Facebook dijo que no fue por política. Mark Zuckerberg dijo lo mismo ante el Senado. Pero Luckey contrató un abogado laboral y negoció una indemnización de más de 100 millones de dólares, argumentando que la empresa había violado la ley de California al castigar a un empleado por actividad política.

Tres meses después de salir de Facebook, fundó Anduril Industries. El nombre viene de la espada de Aragorn en El Señor de los Anillos. La misión: construir tecnología militar autónoma usando IA. Junto a él, exempleados de Palantir y sus antiguos socios de Oculus.

Si Oculus era la cara luminosa de Silicon Valley (democratizar la realidad virtual para todos), Anduril es su sombra: drones autónomos, torres de vigilancia con IA, sistemas anti-drones, y ahora EagleEye, un casco militar con HUD de realidad aumentada, visión nocturna digital, IA integrada, y conectividad con todos los activos del campo de batalla. Todo lo que se te ocurra que te pueden dar como recompensa en un Call of DuTy, Palmer Luckey lo quiere hacer en la vida real con IA. Luckey lo describe así: "No queremos darles una herramienta nueva a los soldados. Les estamos dando un compañero nuevo."

Palmer Luckey tiene 33 años. Su hermana está casada con Matt Gaetz. Colecciona vehículos militares, incluido un Black Hawk y dos submarinos. En 2022 creó un casco de VR que literalmente mata al usuario si muere en el juego (como pieza de arte, inspirada en Sword Art Online). En una entrevista reciente se autodefinió como "sionista radical".

Los números de Anduril:

- 2018: Programa piloto para detectar tráfico de personas y contrabando en la frontera sur de EE.UU. con torres de vigilancia autónomas.

- 2020: Contrato de 967 millones de dólares con la Fuerza Aérea para el Advanced Battle Management System.

- 2022: Contrato de 1.000 millones con las Fuerzas de Operaciones Especiales para sistemas anti-drones.

- Diciembre 2025: China impone sanciones a Luckey por vender armas a Taiwán.

- Valoración actual: 28.000 millones de dólares. Forbes estima la fortuna de Luckey en 3.500 millones.

Como parte de su apuesta por el equipamiento bélico, hace unos meses presentó EagleEye,un casco táctico que con ayuda de la IA aumenta las capacidades de los soldados.

No es un personaje fácil de encasillar. Para unos, es un visionario que vio que la IA iba a ser fundamental para la defensa antes que nadie. Para otros, es la personificación de todo lo que está mal en la relación entre Silicon Valley y el complejo militar-industrial. Lo que nadie puede negar es que su historia conecta perfectamente con el debate de esta semana: ¿deben los labs de IA trabajar con el Pentágono? ¿Con qué límites? ¿Quién decide?

Luckey tiene su respuesta. Amodei tiene la suya. Altman tiene una tercera. Y la respuesta definitiva probablemente no la tenga ninguno de los tres.

Y cerramos la newsletter anunciando la sección de la Herramienta de la Semana que vendrá en el siguiente post, que este ya es muy largo. En la próxima semana hablaremos de Gamma, la app que convierte un prompt en una presentación completa en menos de un minuto, sin abrir PowerPoint. Prometido.

Y hasta aquí la entrega #23 de la Newsletter.

Semana de contrastes. Modelos que se hacen más pequeños y baratos mientras la geopolítica alrededor de la IA se hace más grande y más cara. Nano Banana 2 que ha tenido sus luces y sus sombras (no siempre puedes pegar el pelotazo de Nano Banana “1”). Y un perfil que resume como pocos la tensión entre construir tecnología para todos y construir tecnología para la guerra.La semana que viene, más. Siempre hay más.

Recuerda que puedes puntuar el post y comentar después, por si quieres dar ideas, quejas, sugerencias, peticiones… 🤓

🧠 🧠 🧠 🧠 🧠 ¡Alimento para la mente!

🧠 🧠 🧠 Tienes que pensarlo mejor

🧠 Han faltado neuronas

Y si quieres que tus amigos o familiares estén tan al día de la IA como tú, ¡puedes compartirles esta newsletter o mi blog sobre IA! Uno con contenido de actualidad, y otro con artículos más elaborados, que te ayudarán a entender la IA desde otro punto de vista.

>>> Nos vemos en la siguiente entrega 🤝

>>> ¡ Hasta prompto !