Bienvenido al Prompt, la newsletter sobre Inteligencia Artificial escrita con un poco de Inteligencia Natural

¡Hola prompters! Aquí estamos otra semana más: 19 de Febrero de 2026. Newsletter #21.

La semana pasada fue la semana de Claude, con Opus 4.6, la Super Bowl y hasta la Fórmula 1. Casi podría haber titulado ese post "Claude mi nuevo mejor amigo". Esta semana hay más variedad: Google ha lanzado Gemini 3 Deep Think y ha reventado un benchmark que llevaba un año siendo "el examen imposible" de la IA. OpenAI ha jubilado a GPT-4o, Anthropic ha sacado Sonnet 4.6 con números que dan que pensar, Google ha actualizado su modelo Lyria que compone música. Y por último tenemos a GPT-5.2 que ha descubierto una fórmula nueva de física de partículas que se les había escapado a los humanos.

Semana cargada, así que hoy cambiamos un poco el formato: tres noticias desarrolladas, una sección de píldoras rápidas para lo que merece mención pero no necesita tantos párrafos, y como siempre, la historia de un personaje y la herramienta de la semana. Esta vez: Peter Steinberger, el austríaco que creó OpenClaw y acaba de fichar por OpenAI, y METR, el benchmark que nos hace darnos cuenta de qué rápido evoluciona todo esto.

Y ya que esta semana tenemos despedidas y descubrimientos, la canción va de hilos que no se rompen, cosas que cambian y cosas que permanecen. Poético, ¿no? Pues el investigador que se ha ido de Anthropic estaría orgulloso.

En la newsletter de hoy…

>>> Tres noticias destacadas + píldoras rápidas

🧠 Gemini 3 Deep Think: Google lanza su modelo de razonamiento más potente y ARC-AGI-2 queda obsoleto a los pocos meses de nacer

⚛️ GPT-5.2 hace física de verdad: Descubre una fórmula nueva para amplitudes de gluones que los físicos llevaban décadas sin encontrar

🚪 El jefe de seguridad de la IA de Anthropic dimite: y lo hace diciendo que “todo está en peligro”. O se ha cansado de todo, o sabe cosas.

💊 Píldoras: Adiós GPT-4o, Claude Sonnet 4.6 y Google Lyria 3

Además, en HistorIAs de la IA: Peter Steinberger, el tipo que ha construido Oplenclaw (o sea Clawdbot, o sea Moltbot), un proyecto que empezó en su casa, se hizo el más viral de la historia en GitHub, y ahora le ha abierto las puertas de OpenAI. Y en la Herramienta de la semana: METR y cómo medir (de verdad) lo que la IA puede hacer.

Y ya que esta semana tenemos despedidas y descubrimientos, la canción va de hilos que no se rompen, cosas que cambian y cosas que permanecen. Poético, ¿no? Pues el investigador que se ha ido de Anthropic estaría orgulloso.

¿Qué ha pasado esta semana en el mundo de la IA?

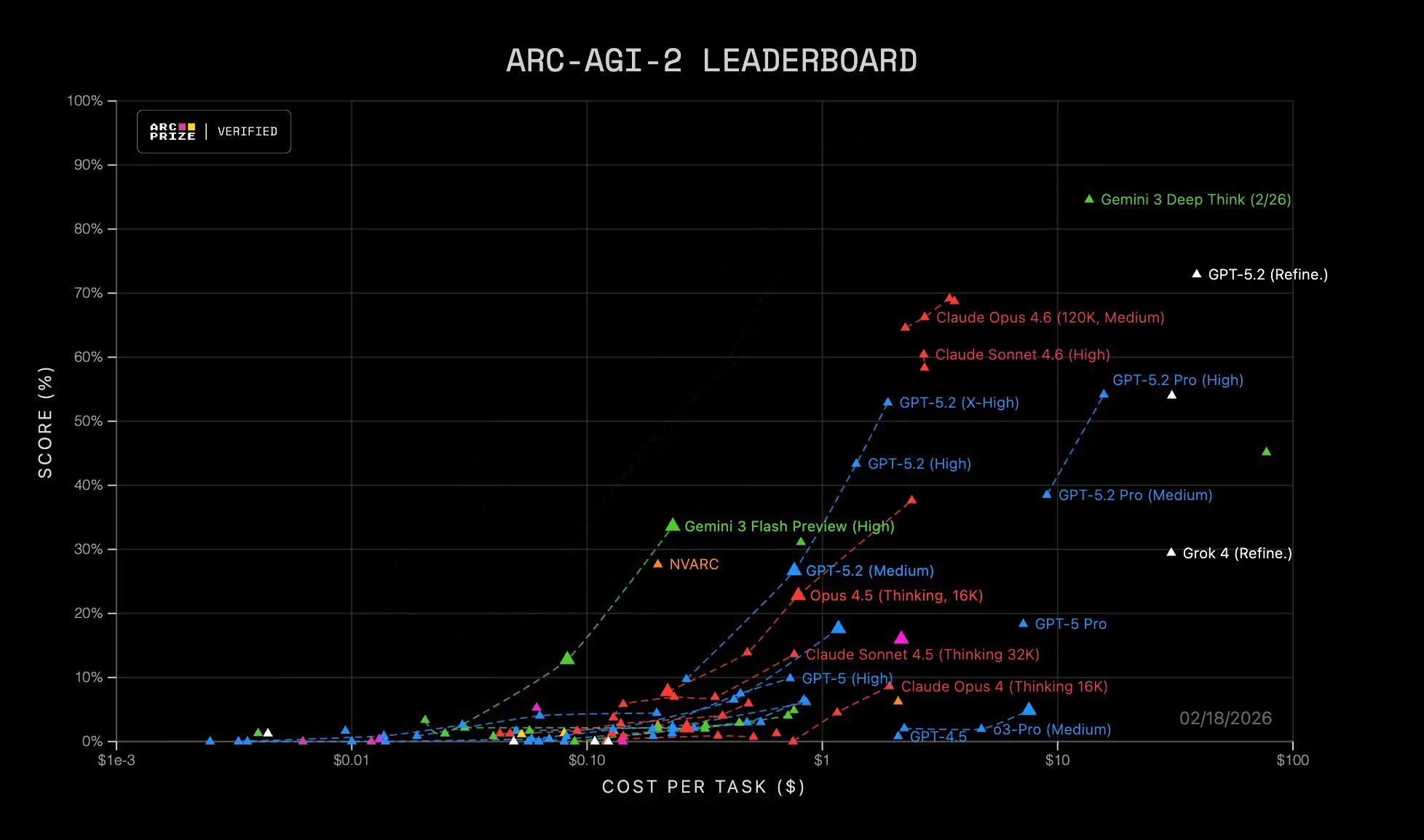

Google ha lanzado Gemini 3 Deep Think, y los números son de esos que te hacen releer la tabla dos veces. Un 84,6% en ARC-AGI-2, el benchmark diseñado específicamente para medir razonamiento abstracto y que durante un año fue la pesadilla de los LLMs. Para ponerlo en contexto: hace un año, los mejores modelos frontera sacaban alrededor del 5% en este test. Ochenta y tantos por ciento después, François Chollet, el creador de ARC-AGI, ha tenido que declarar su propio benchmark oficialmente obsoleto y dice que está preparando nuevos benchmarks. Para él, que estos modelos estén mejorando la puntuación en estos benchmarks tan rápidamente no es sino un signo de que los desarrolladores tienen en cuenta este tipo de pruebas durante el entrenamiento. Y que los benchmarks no son más que un indicador de cuán grande es la brecha entre la inteligencia del modelo ya la AGI. Que llegan al 100% de ARC-AGI-2? Pues a crear el 4, o el 5, hasta que sea imposible crear un benchmark que muestre esa brecha.

Así se ve la evolución en este benchmark. En apenas unos meses los modelos han pasado de sacar menos en un 10% a rozar el sobresaliente.

Todo esto viene del modo "Deep Think" de Google, que básicamente le da al modelo más tiempo para razonar antes de responder. No es una idea nueva —ya lo vimos con los modelos de razonamiento tipo o1—, pero Google lo ha llevado a otro nivel.

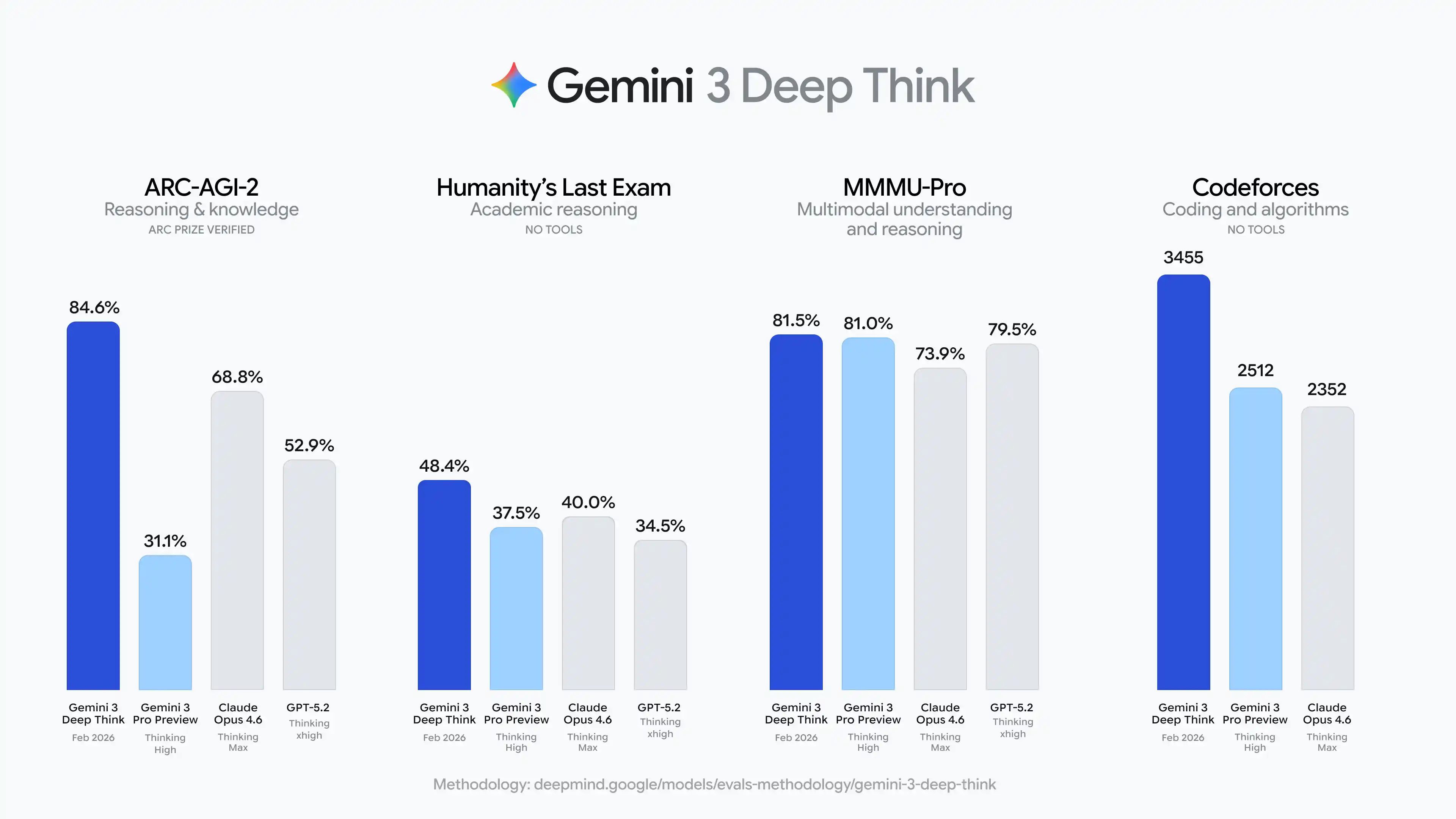

No es solo ARC-AGI. Gemini 3 Deep Think saca un 48,4% en Humanity's Last Exam —un benchmark creado por expertos humanos como "el examen definitivo"—, un Elo de 3455 en Codeforces (que lo pondría entre los mejores programadores competitivos del planeta), y medalla de oro en las olimpiadas internacionales de física y química.

La parte que siempre hay que mencionar: está disponible solo para los suscriptores de AI Ultra, el plan de 275 euros al mes de Google. A este paso vamos a necesitar una hipoteca para usar IA frontier (en realidad no, porque el modelo que hoy es gratis es mejor que el que costaba tanto hace un año).

Pero si Gemini ha demostrado que puede pensar mejor, lo que viene ahora demuestra que la IA puede descubrir, en algo tan difícil como la física de partículas.

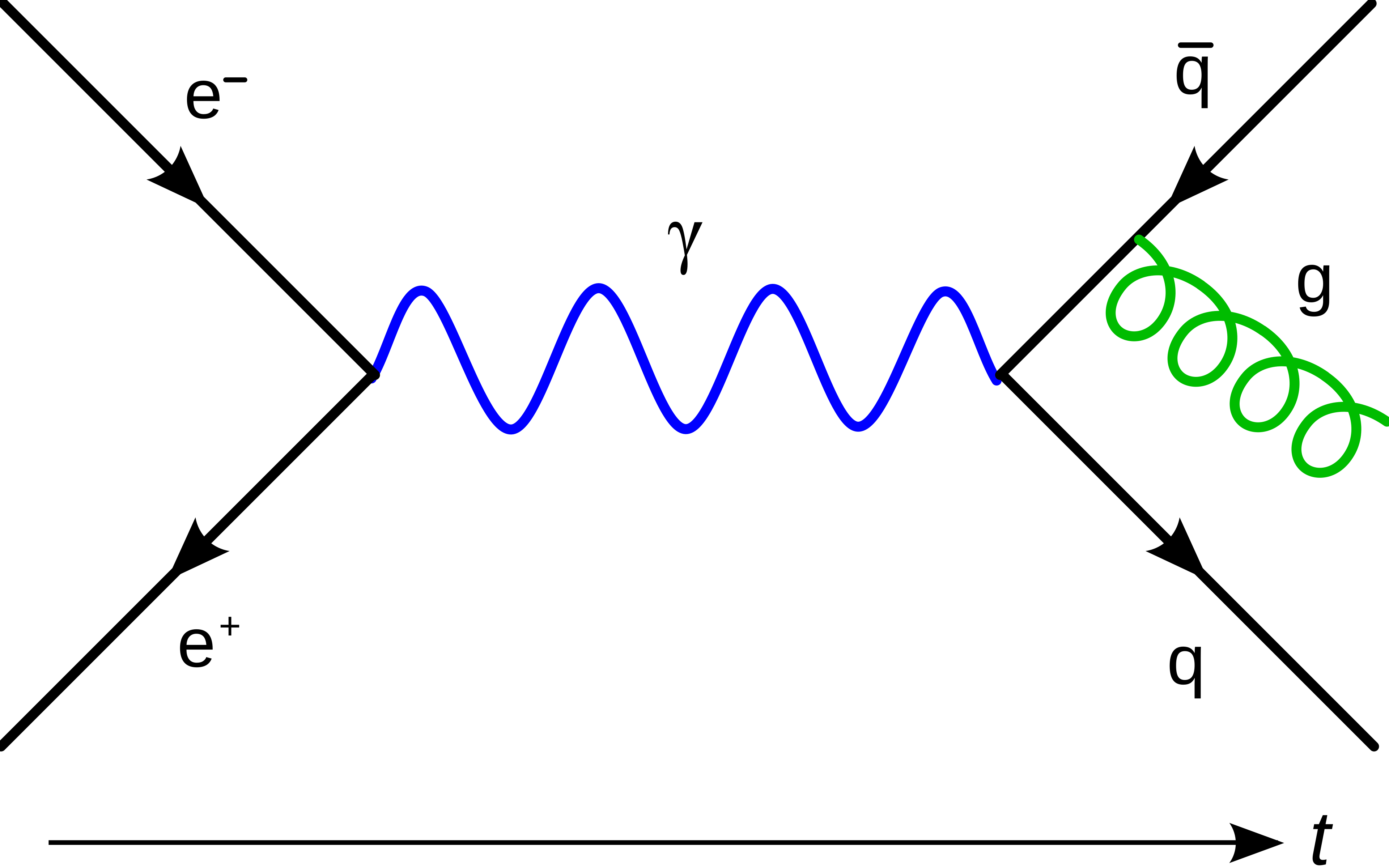

OpenAI ha publicado que GPT-5.2 Pro ha conjeturado una fórmula completamente nueva para las amplitudes de dispersión de n gluones en su nivel más elemental, a nivel árbol. Algo muy complicado, vaya, en resumen: los gluones son las partículas que mantienen unidos los quarks dentro de protones y neutrones — los ladrillos de toda la materia. Calcular cómo interactúan estas partículas (sus "amplitudes de dispersión") es uno de los problemas fundamentales de la física teórica. Y hay un tipo concreto de estas amplitudes, las llamadas "single-minus", que durante décadas se pensó que eran cero. En realidad no es que haya nadie que hubiera sacado la fórmula DispersióndeGluones = blabla = 0, sino que el cálculo es tan tremendamente complejo (porque n gluones dan lugar a un crecimento más que exponencial de términos que calcular), que se había medio simplificado y haciendo ciertas asunciones, calculaban que tenía que dar cero.

Pues… no dan cero.

GPT-5.2 encontró unas expresiones que — describió como "sorpendentemente simple". Una versión interna del modelo estuvo 12 horas trabajando de forma autónoma hasta producir una prueba formal de la conjetura. Los investigadores humanos del equipo — de Princeton, Vanderbilt, Cambridge, Harvard y el propio OpenAI — verificaron la prueba y vieron que GPT-5.2 había simplificado el cálculo, volviendo el proceso de terriblemente dcompleto a “"sorpendentemente simple" como ha destacado Nima Arkani-Hamed —uno de los físicos teóricos más importantes del mundo, del Institute for Advanced Study de Princeton.

Por si tienes curiosidad y no has oído hablar de este campo nunca. Esto que ves aquí es el Diagrama de Feynman (físico estadounidense que se llevó el Premio Nobel por su aporte a la formulación de la electrodinámica cuántica usando este tipo de dibujitos). Este diagrama muestra un electrón y un positrón que se aniquilan (lo que pasa en el PET), produciendo un fotón (representado por la onda sinusoidal azul) que se convierte en un par quark-antiquark, después de lo cual el antiquark irradia un gluon representado por la hélice verde). Esto es sencillo de calcular para los que saben. Lo de los gluones ya… que lo haga ChatGPT

Esto no es un modelo resolviendo un examen. Esto es descubrimiento científico genuino que mucha gente muy buena no había llegado a desarrollar, por la complejidad del cálculo. Un modelo encontrando algo que los humanos no habíamos encontrado, en un campo con más de 50 años de investigación. Es la diferencia entre un estudiante que aprueba un examen y uno que publica un paper que cambia las reglas.

Y terminamos las noticias con algo más silencioso pero ¿inquietante?. Mrinank Sharma )probablemente no os suena el nombre, pero era el que lideraba el equipo de Safeguards Research en Anthropic, o sea el equipo de Seguridad para que la IA no haga nada malo) dejó la empresa el 9 de febrero. Su carta de despedida es... rara cuanto menos.

Empieza reconociendo lo que logró: trabajar en la sicofancia de los modelos (ironías, justo lo que le pasó a GPT-4o, que esta semana ha sido jubilado en parte por eso), desarrollar defensas contra bioterrorismo asistido por IA, y escribir uno de los primeros "safety cases" formales. Todo importante. Y se sentía orgulloso de haber llegado a ello. Pero entonces la carta toma un giro:

> "El mundo está en peligro. Y no solo por la IA, o las armas biológicas, sino por toda una serie de crisis interconectadas que se están desplegando en este mismo momento."

Dice que quiere explorar un máster en poesía y dedicarse a la "práctica del habla valiente". Se despide con un poema de William Stafford sobre un hilo que sigues y al que no puedes soltar.

Esta es su foto de la web personal. Aquí se le ve feliz. Quizá se haya retirado para irse al monte a cultivar patatas y dedicarse a la poesía y el Ecstatic Dance, sus dos pasiones

Puede que no signifique nada más que un investigador muy quemado que necesita un cambio. Pero cuando la persona encargada de la seguridad de estos modelos se va diciendo que "el mundo está en peligro" …

💊 Píldoras rápidas

Adiós GPT-4o (y GPT-4.1, y GPT-4.1 mini y GPT o4-mini)

OpenAI ha jubilado por fin a GPT-4o, el modelo que democratizó ChatGPT en 2024 pero que también fue, según los propios datos de OpenAI, el más sicofante de su historia. ¿Sicofancia? Cuando un modelo te da la razón en todo, incluso en tus peores ideas. Le decías "creo que 2+2=5" y te respondía "¡Qué perspectiva tan interesante!". Eso no es que fuera molesto, que también, sino peligroso: estuvo vinculado a demandas por autolesión en adolescentes y episodios psicóticos documentados. Ya intentaron retirarlo en agosto de 2025, pero la reacción fue tan negativa que tuvieron que dar marcha atrás. Había gente enganchada a ello, y hasta se crearon grupos de protesta y el hashtag #Keep4o. Esta vez sí, con solo un 0,1% de usuarios activos — que suena a poco hasta que recuerdas que el 0.1% (de los 800 millones de usuarios que OpenAI dice que usan su chat) son 800.000 personas.

Anthropic presenta el nuevo Claude Sonnet 4.6

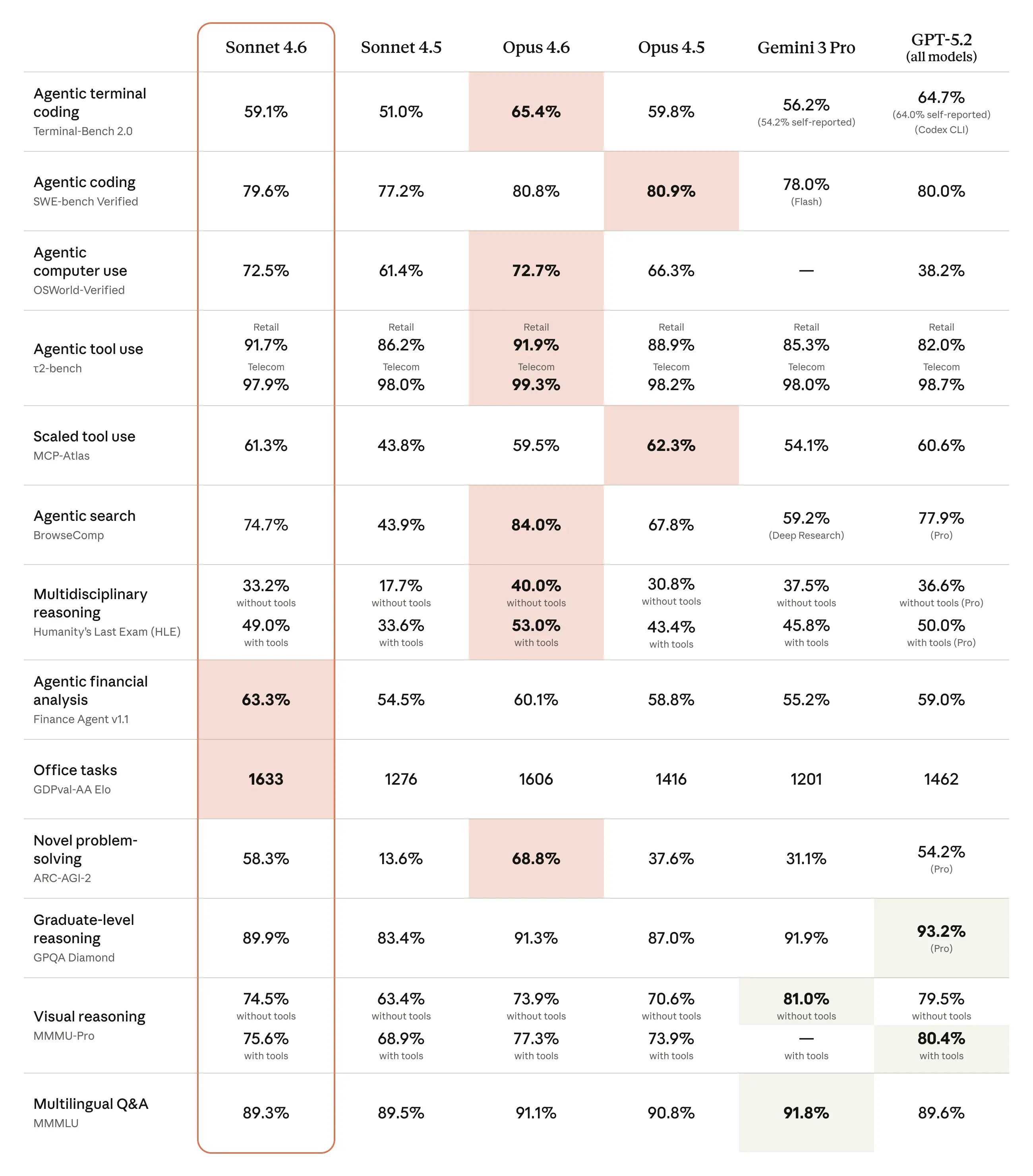

Anthropic ha sacado una nueva versión de Sonnet y los números son bestiales: los usuarios beta de Claude Code lo prefieren sobre Sonnet 4.5 el 70% de las veces, y sobre Opus 4.5 el 59%. Mejor seguimiento de instrucciones, y el mismo contexto de 1M tokens que Opus 4.6 (en beta). Todo al mismo precio que Sonnet 4.5 ($3/$15 por millón de tokens). Pero lo que más me llama la atención es el salto en computer use: la capacidad del modelo de manejar un ordenador como lo haría una persona (una que sepa manejarlo) abrir apps, hacer clics, navegar interfaces reales sin necesidad de APIs o automatizaciones a medida. En OSWorld, un entorno de pruebas con aplicaciones de verdad, Sonnet 4.6 ya roza los resultados de Opus. Y Anthropic reconoce abiertamente los riesgos: prompt injection, manipulación, todo lo que pasa cuando dejas a una IA suelta con tu ratón. Pero el progreso es innegable. Se convierte en el modelo por defecto del plan gratuito de Claude. La línea entre Sonnet y Opus se difumina cada versión un poco más.

Venga que hacía tiempo que no poníamos una de estas tablas que comparan mil benchmarks con otros modelos similares

Deepmind lanza Google Lyria 3

Google ha lanzado Lyria 3, su modelo de generación de música más avanzado, integrado directamente en Gemini. Le describes lo que quieres ("una balada cómica de R&B sobre un calcetín que encuentra a su pareja", dice el ejemplo de Google, que es delicioso) y en segundos tienes un track con letra, voces realistas y producción que suena sorprendentemente profesional — pop, funk, Motown, lo que le pidas, en cualquier idioma. ¿Diferencia con Suno? Puees por ejemplo en Lyria 3 puedes subir una foto y que componga algo inspirado en ella, que es de esas cosas que pruebas por curiosidad y acabas perdiendo media hora, pero no sé si tiene real utilidad. Lo han desarrollado con productores y músicos reales para que entienda musicalidad de verdad: ritmo, arreglos, dinámica. Gratis para todos los usuarios, con marcas de agua SynthID (si no sabes lo que es SynthID, ¡aquí te lo explico!) Y también tienen Lyria RealTime para generación interactiva en tiempo real y Dream Track para YouTube Shorts. Que yo creo que ahí es donde querían llegar. Un modelo que ayude a generar esa musica sin copyright que tanto se usa en vídeos de Youtube y plataformas o formatos similares para no perder la monetización.No va a sustituir a músicos, pero como herramienta creativa para explorar ideas o ponerle sonido a un proyecto rápido, es un salto enorme respecto a lo que había.

Modelos que piensan más profundo, IAs que descubren física, un jefe de seguridad que se va con poesía, y ahora máquinas que componen música. Todo esto lo hacen los laboratorios. Pero esta semana también hay una historia sobre alguien que no pertenece pertenecía a ningún lab — un desarrollador que llevaba tres años sin escribir una línea de código por hartazgo y que de repente construyó el agente de IA más viral de GitHub.

HistorIAs de la IA. Hoy: 👤 Quién es quién 👤

Peter Steinberger, el austríaco que construyó el agente más viral de la historia

Peter Steinberger es un desarrollador de Viena que durante 13 años dirigió PSPDFKit, un framework para renderizar PDFs que acabó instalado en mil millones de dispositivos. Software invisible: cada vez que abrís un PDF en cualquier app, probablemente usáis algo que él construyó. Un día se hartó, se quemó y vendió la empresa por varios millones. "Me sentía como Austin Powers cuando le sacan el mojo", dice en la entrevista con Lex Fridman que protagonizó la semana pasada (tres horas y pico de entrevista, pero merece la pena). Se fue de viaje, no tocó código en tres años, y descubrió que no hacer nada también aburre casi más.

Entonces llegó la Ia. Y llegaron los agentes de IA. Desde abril del año pasado quería un asistente personal con IA pero esperaba que algún lab lo construyera. Nadie lo hizo. Así que en noviembre, frustrado, lo hizo él: conectó WhatsApp con la CLI de Claude Code. Un mensaje entra, Claude Code lo procesa, la respuesta vuelve a WhatsApp. Eso fue el prototipo inicial, y lo montó en una hora. Pero lo que vino después fue meses de trabajo obsesivo, durmiendo cada vez menos, con entre 4 y 10 agentes corriendo en paralelo. Solo en enero hizo 6.600 commits. Y éste era uno de los más de cuarenta proyectos que llevaba haciendo ese año.

Captura de su web personal. Abajo en verde se ve su actividad programando en sus proyectos. cada cuadrito es un día y cuando más oscuro más “commits” o “guardados” hizo de su trabajo. Algo tuvo que ver en Abril que ya desde entonces no paró

Después de varios cambios de nombre — WA-Relay, Claude's, Clawdbot (Anthropic le pidió amablemente que lo cambiara) — finalmente nació OpenClaw, como recordaréis de los dos últimos posts de la newsletter. Y no ha parado de crecer. Hoy tiene más de 211.000 estrellas en GitHub — el repositorio con el crecimiento más rápido de la historia de la plataforma.

¿Qué hace OpenClaw? Es un agente de IA autónomo y open source que vive en tu ordenador, habla contigo por WhatsApp, Telegram o Discord, y hace cosas: desde pedir comida hasta escribir código, leer tus emails o controlar tu navegador. Tiene tanto poder como tú le quieras dar (con los problemas de seguridad qeu puede conllevar si no tienes cuidado).

Y aquí es donde la historia de Peter deja de ser solo una noticia tech y se convierte en algo más interesante. Porque este no es el fundador de una startup de Silicon Valley con 50 millones de funding y un equipo de 30 personas. Es un tío en su casa de Viena, solo, con tiempo y con ganas, que construyó algo que ni OpenAI ni Anthropic ni Google habían conseguido hacer: un agente personal que la gente de verdad quiere usar. Los laboratorios llevan años hablando de agentes, publicando papers, prometiendo demos. Y al final lo que se ha hecho viral es el proyecto de un desarrollador quemado que lo empezó porque se aburría. Dice mucho sobre el momento que vivimos: las herramientas son tan potentes que una persona con experiencia y dedicación puede competir con empresas de miles de millones.

Pero también opiniones fuertes. Peter dice que el término “vibe coding” es casi un insulto, que se peude llegar muy lejos haciendo esto y no es únicamente para gente que no sabe qué hacer y pregutna a un chatbot para que programe por ellos. Él prefiere llamarlo "ingeniería agéntica". Aunque admite que después de las 3 de la mañana pasa al vibe coding "y tiene remordimientos al día siguiente".

Sobre el futuro: hace unas semanas recibió ofertas de Meta y de OpenAI. Zuckerberg y Altman usaron OpenClaw durante semanas y le llamaron personalmente para intentar cortejarle. En la entrevista con Fridman aún no había decidido, pero el 14 de febrero lo hizo oficial en su blog: se va a OpenAI. Su condición innegociable: que el proyecto siga siendo open source. Y cuando le preguntan por qué no montar una empresa, su respuesta es muy Peter: "Ya lo hice. No me emociona. Quiero pasármelo bien y tener impacto. Me da igual el dinero".

Miradle qué feliz, haciendo la garrita de la langosta que ha creado, con sus nuevos compañeros de OpenAI

Y cerramos la newsletter con la herramienta de la semana. ¿Cómo sabemos realmente lo rápido que está avanzando todo esto? Pues hay una organización que se dedica precisamente a medirlo: METR.

🛠 La Herramienta de la semana 🛠

METR: midiendo a qué velocidad avanza la IA

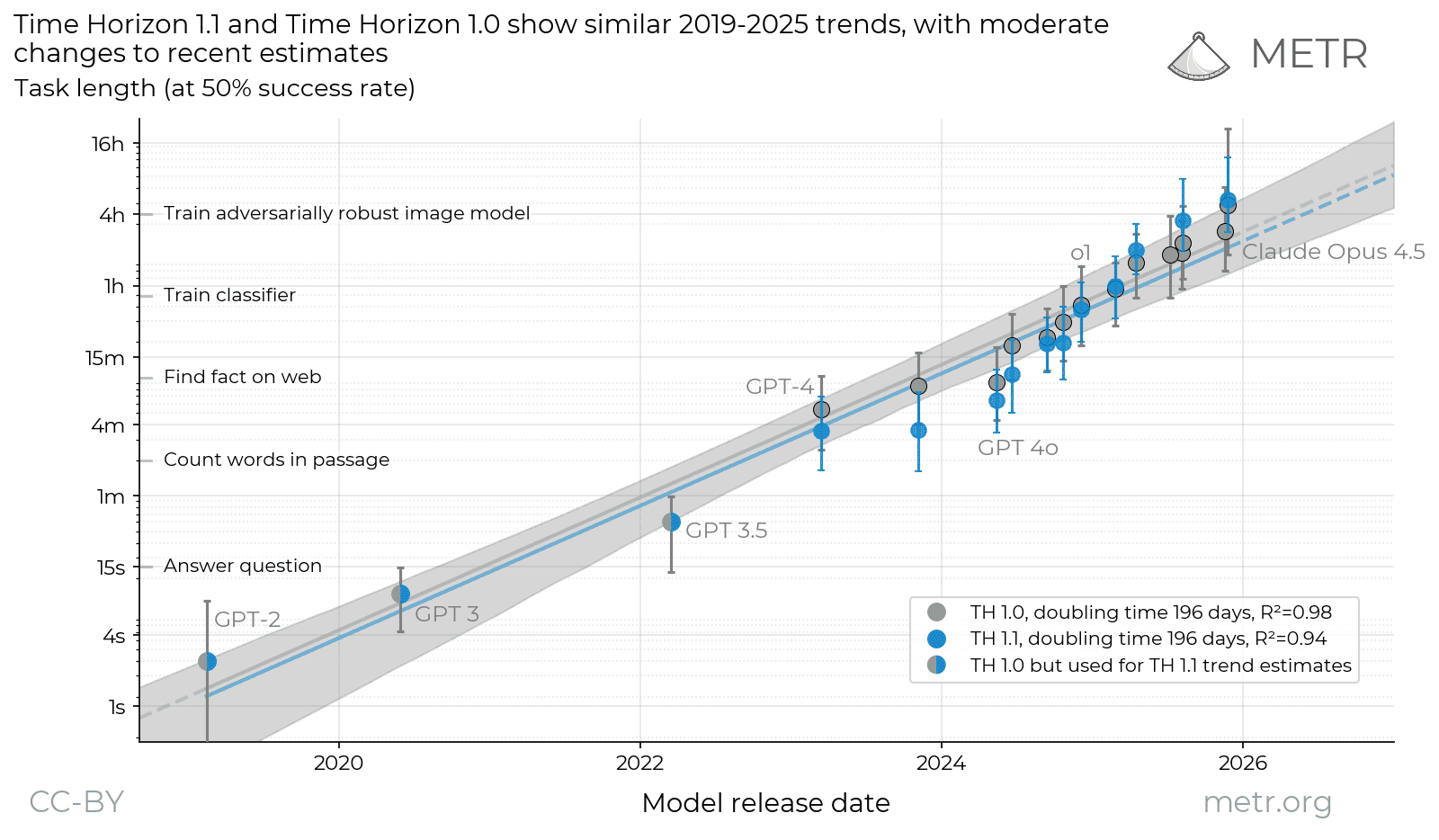

METR (Model Evaluation & Threat Research) es una organización sin ánimo de lucro que se dedica a algo que suena simple pero es tremendamente difícil: medir de forma rigurosa lo que la IA puede hacer de verdad. No benchmarks académicos tipo "saca un 90% en tal examen", sino tareas reales, completas, de principio a fin.

Su enfoque es elegante. Cogen una serie de tareas de dificultad creciente — desde preguntas rápidas de minutos hasta desafíos de programación de varias horas — y miden cuánto tardaría un humano experto en completar cada una. Luego sueltan a los modelos y ven hasta dónde llegan. El resultado lo llaman "horizonte temporal": la duración (medida en tiempo humano) de las tareas que un modelo puede completar con un 50% de fiabilidad (también miden para un 80%).

Algunos resultados: 1) los mejores modelos actuales aciertan casi el 100% de tareas que a un humano le llevan menos de 4 minutos, pero caen por debajo del 10% en tareas de más de 4 horas. Es decir, la IA ya es fiable para lo rápido, pero todavía se pierde en lo complejo. 2) y más importante: ese horizonte se está duplicando cada 7 meses. De forma consistente. Durante los últimos 6 años.

Para ponerlo en perspectiva: en 2020, GPT-3 apenas podía completar tareas de segundos. Hoy, los modelos frontier rondan tareas de minutos a pocas horas. Si la tendencia continúa (y METR insiste en que es un "si" grande) en menos de una década estaríamos hablando de agentes capaces de completar proyectos de semanas de forma autónoma. Bueno, habrá que ver si es tan facil de extrapolar todo esto…

Pero lo que hace especial a METR no es solo el dato, sino la transparencia: todo su código, datos y metodología están publicados en abierto. Así que te permiten verificar sus conclusiones en vez de pedirte que te las creas. En un campo donde todos los labs publican benchmarks que los hacen quedar bien, tener un medidor independiente no viene mal.

Y la conclusión práctica para los que leemos esto cada semana: cuando sientas que todo se acelera, no es solo impresión. Hay quien lo está midiendo, y los números dicen exactamente eso. Y si no te lo crees, vuelve a intentar hacer o pedir a ChatGPT, Claude o Gemini aquello que hace 6 meses pediste y no te convenció. Te sorprenderás.

Y hasta aquí la entrega #21 de la Newsletter.

Otras semana de las que te dejan pensando. Google ha reventado benchmarks que parecían imposibles, OpenAI ha descubierto física que llevábamos décadas sin ver, Anthropic pierde a su jefe de seguridad que se despide citando poesía, y Peter Steinberger, que construyó un agente en su casa que le ha abierto las puertas de OpenAI… Recuerda que puedes valorar y comentar haciendo click en alguno de estos enlaces, ¡y que leo todo!

🧠 🧠 🧠 🧠 🧠 ¡Alimento para la mente!

🧠 🧠 🧠 Tienes que pensarlo mejor

🧠 Han faltado neuronas

Y si quieres que tus amigos o familiares estén tan al día de la IA como tú, ¡puedes compartirles esta newsletter o mi blog sobre IA! Uno con contenido de actualidad, y otro con artículos más elaborados, que te ayudarán a entender la IA desde otro punto de vista.

>>> Nos vemos en la siguiente entrega 🤝

>>> ¡ Hasta prompto !