Bienvenido al Prompt, la newsletter sobre Inteligencia Artificial escrita con un poco de Inteligencia Natural

¡Hola prompters! Nueva entrega semanal: 12 de Febrero de 2026. Newsletter #20.

Si la semana pasada os dije que las cosas iban rápido, esta ha sido directamente un sprint. Anthropic ha sacado Claude Opus 4.6, su modelo más potente (y caro) hasta la fecha, OpenAI ha respondido literalmente diez minutos después con el suyo, GPT-5.3 Codex, los dos se han tirado los trastos a la cabeza en la Super Bowl, y Claude hasta se ha subido a un Fórmula 1. La semana de Claude, sin duda.

Pero lo mejor es el salseo. Porque esta semana la IA ha dejado de ser solo papers y benchmarks para convertirse en drama televisivo. Y yo estoy aquí para contároslo todo.

En la newsletter de hoy…

>>> Tres noticias destacadas

🤖 Opus 4.6 vs GPT-5.3-Codex: Anthropic y OpenAI lanzan sus últimos modelos el mismo día. A minutos de diferencia. Coincidencia, ¿verdad?

🏈 Super Bowl de la IA: Anthropic ataca a OpenAI en sus anuncios, Sam Altman se pica, y el drama se traslada a Twitter

🏎️ Claude llega a la F1: Anthropic se asocia con Atlassian Williams Racing como "Official Thinking Partner”. ¿Patrocinio o colaboración real?

Además, como no hablamos de Anthropic suficiente en este post, hablemos un poquito más en HistorIAs de la IA. Esta vez contamos la historia de Amanda Askell, la filósofa que ayudó a dar alma, y ética, a Claude, y que ha dirigido la creación de la “Constitución de Claude”. Y en nuestra sección de Herramienta de la Semana hablaremos de Seedance 2.0 de ByteDance — generación de vídeo con IA que deja con la boca abierta.

Y del salseo de los anuncios la SuperBowl, a la salsa del descanso de la SuperBowl. Este año fue Bad Bunny quien cantó en el show de medio tiempo, en una actuación muy reggaetonera, pero también salsera, así que nuestra canción de la semana está inspirada en ese reggaetón puertorriqueño juguetón.

¿Qué ha pasado esta semana en el mundo de la IA?

🤖 Duelo de titanes: Opus 4.6 y GPT-5.3-Codex se lanzan el mismo día (a minutos de diferencia)

El 5 de febrero, Anthropic publicó Claude Opus 4.6, su modelo más avanzado hasta la fecha. Apenas diez minutos después, OpenAI respondió con GPT 5.3-Codex. Si no fuera porque la IA ahora hace las cosas automáticamente, diría que había un emplead de OpenAI con el dedo puesto en el botón de publicar esperando a que Anthropic moviera ficha para robarle el foco. Pero ¿qué traen de nuevo estos modelos?

Claude Opus 4.6: más contexto, más profundo, más rápido, más caro

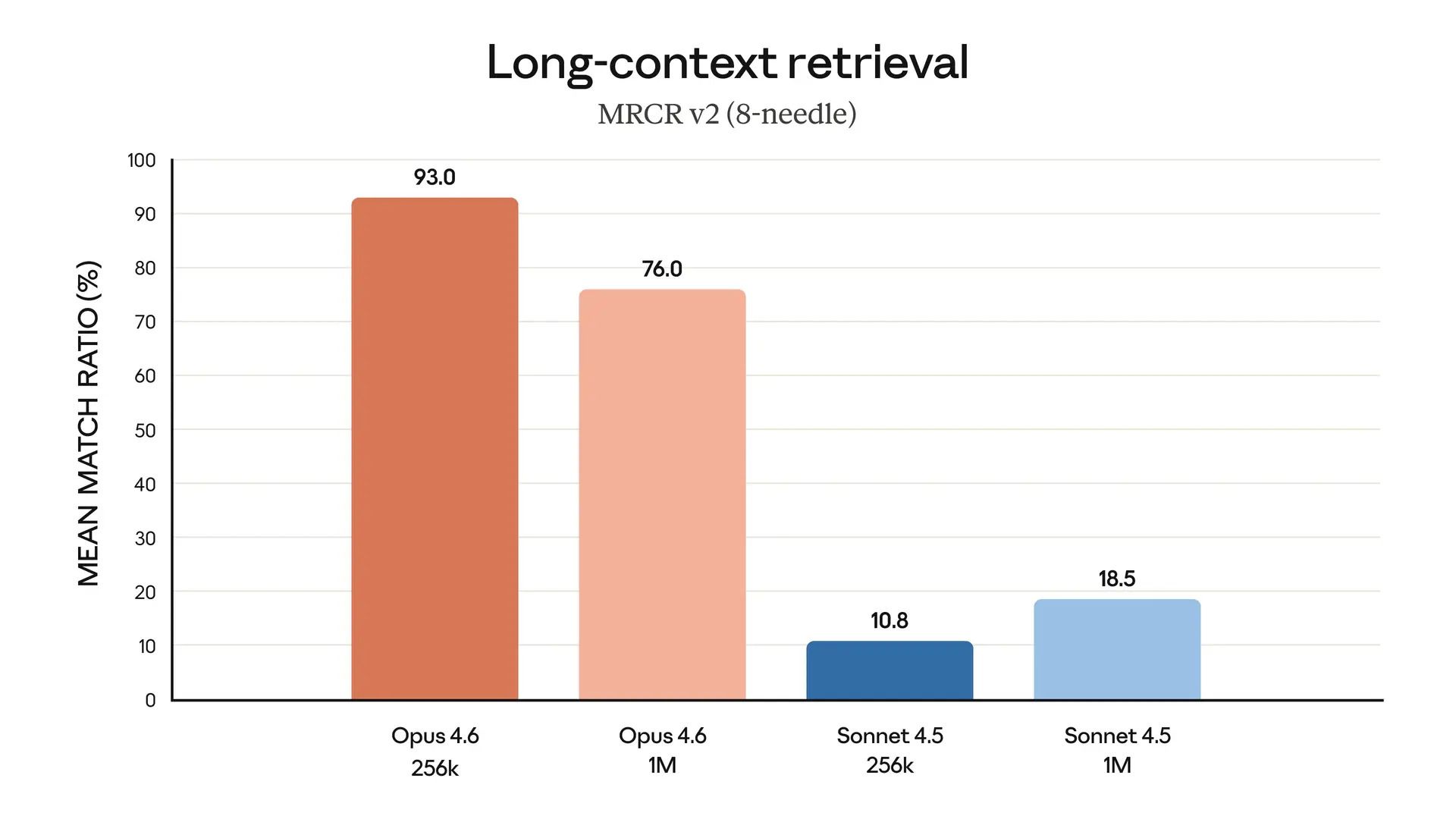

Opus 4.6 es el primer modelo Opus con ventana de contexto de 1 millón de tokens (en beta). Para que te hagas una idea: eso son unas 750.000 palabras, más o menos como meter 10 novelas completas en una sola conversación sin que el modelo pierda el hilo (más o menos, que no es que se vuelta tonto en el token 999.999, sino que va perdiendo capacidades progresivamente). Pero no es solo que quepa más texto: Anthropic ha mejorado drásticamente la capacidad de recuperar información enterrada en contextos largos. En un benchmark de "aguja en un pajar" (MRCR v2), Opus 4.6 saca un 76% frente al 18,5% de Sonnet 4.5 on la misma ventana de contexto.

El benchmark de Aguja en un pajar, o MRCR es de mis favoritos. Te dice cuánto se lía cuando tiene que buscar un poco de información en todo su contexto. Es como si le mandas un audio de 50min a tu amigo y luego le preguntas algo que le dijiste en el minuto 23:48 y tiene saberlo. Cuanto mayor el contexto (más largo el audio que le mandas) más información puede tener, pero puede que se pierda más fácilmente.

En benchmarks de programación agéntica, razonamiento multidisciplinar y trabajo profesional (finanzas, legal, análisis de datos), Opus 4.6 lidera en prácticamente todas las categorías. Y también introduce equipos de agentes en Claude Code: múltiples agentes trabajando en paralelo y coordinándose entre ellos. De hecho, unos de los logros más impresionantes que dicen que hizo Opus 4.6 fue gracias a estos equipos de agentes: Nicholas Carlini, investigador de Anthropic, usó 16 agentes de Opus 4.6 para programar un compilador de C completo: 100.000 líneas de Rust, en dos semanas, por 20.000 dólares en coste de API. Con ese compilador compilaron un kernel Linux funcional en x86, ARM y RISC-V. Un proyecto que históricamente costaba más de 2 millones de dólares y 2 años de trabajo con un equipo de 15-20 personas. Lejos de ser perfecto, pero el mensaje es claro: lo que antes era una montaña de ingeniería humana, ahora es una factura (bastante barata) de API. Aquí tienes el post de Nicholas por si quieres leer sobre esto (o que te lo resuma alguna IA) en profundidad.

OpenAI, por su parte, presentó GPT-5.3-Codex como su modelo de programación agéntica más avanzado. Combina las capacidades de coding de GPT-5.2-Codex con el razonamiento de GPT-5.2, pero un 25% más rápido y usando menos tokens para lograr los mismos resultados. Récord en SWE-Bench Pro (56,8%), un salto brutal en Terminal-Bench 2.0 (77,3% vs 64% anterior) y mejoras muy notables en OSWorld (64,7% vs 38,2%), por si eres de los que aún siguen los benchmarks.

A este ritmo de publicación de modelos, casi todas las semanas tenemos alguno que mejora tal o cual benchmark. En este punto ya da igual. Si sacan algo nuevo, será porque es mejor en algo. Lo interesante es la velocidad a lo que todo va progresando. Cuán mejor se ve GPT 5.3 Codex vs GPT-5 o Opus 4.6 vs lo que había hace 8 meses.

Por otro lado, dicen en OpenAI que GPT-5.3-Codex es el primer modelo de OpenAI que ha sido "instrumental en su propio desarrollo", un poco en la línea de lo que dice Dario Amodei de sus Claudes. “Versiones tempranas del modelo se usaron para depurar su entrenamiento, identificar patrones y optimizar el despliegue.”" El bucle de auto-mejora del que hablábamos en la Newsletter #18 pero en versión OpenAI

La evolución de los modelos en apenas un año es vertiginosa. Mejoras graduales que, vistas en perspectiva, son un salto gigantesco. Aquí mostramos el benchmark lanzado por OpenAI diseñado específicamente para evaluar la capacidad de los modelos de Inteligencia Artificial (IA) en tareas laborales reales y económicamente valiosas.

¿Quién gana?

Pues no todo es blanco o negro: depende de qué necesites. Opus 4.6 brilla en contextos largos, razonamiento profundo y tareas que requieren "pensar más", igual que hacía Opus 4.5 pero más caro, más rápido y con más memoria. GPT-5.3-Codex es una máquina de coding más ágil y eficiente en tokens. Y ambos son mejoras graduales sobre sus predecesores. Pero echa la vista atrás un año: de GPT-4 y Claude 3.7 a esto. La curva de mejora sigue siendo exponencial, aunque cada salto individual parezca menor.

Y si pensabas que la rivalidad entre Anthropic y OpenAI se limitaba a benchmarks y papers técnicos... oh no, no, espera a ver lo que pasó el domingo.

🏈 La Super Bowl de la IA: cuando los anuncios se convierten en guerra abierta

Hay un parte de la Super Bowl que es más famosa que la propia Super Bowl. Bueno, dos. 1) Su show de medio tiempo y 2) los anuncios que se emiten en el descanso, que cuestan una millonada. Y en estos anuncios, este año, la IA fue protagonista con anuncios de Google (Gemini), Meta (gafas Oakley AI), Amazon (Alexa+ con Chris Hemsworth), Wix (su plataforma de vibe coding) y varias más. Pero el verdadero espectáculo estuvo entre bastidores.

Anthropic gastó millones en varios spots satíricos con titulares como "Traición", "Engaño" y "Violación", todos con el mismo tagline: "Ads are coming to AI. But not to Claude", es decir “los anuncios han llegado a la IA, pero no a Claude”. Los anuncios parodiaban cómo sería un asistente de IA que te mete publicidad mientras intentas trabajar—imagina pedirle a tu chatbot un resumen financiero y que te recomiende unas plantillas "Step Boost Maxx" de camino. Sin nombrar a OpenAI directamente, el dardo era obvio: OpenAI anunció hace poco que introducirá anuncios en ChatGPT.

Y entonces Sam Altman se picó. El CEO de OpenAI se descolgó con un post largo en X respondiendo punto por punto. Os dejo algunas frases:

“Anthropic ofrece un producto costoso a gente rica. Nos alegra que lo hagan y nosotros también lo estamos haciendo, pero también sentimos firmemente que necesitamos llevar la IA a miles de millones de personas que no pueden pagar suscripciones.” Y también "Anthropic quiere controlar qué hacen las personas con la IA — bloquean a las empresas que no les gustan de usar su producto de coding (incluso a nosotros), quieren escribir ellos mismos las reglas para qué pueden y qué no pueden usar las personas para IA, y ahora también quieren decirle a otras empresas cuáles pueden ser sus modelos de negocio."

Eso sí, empezó diciendo que le habián hecho gracia los anuncios. No sé yo…

Daniela Amodei, presidenta de Anthropic, insistió en que los anuncios no iban dirigidos a "ninguna otra empresa que no fuéramos nosotros mismos". Además, Anthropic publicó un blog post titulado "Claude es un lugar para pensar" donde explican por qué han decidido mantener Claude libre de publicidad. Su argumento: las conversaciones con chatbots son demasiado personales como para llenarlas de anuncios segmentados. Es un posicionamiento interesante, aunque falta ver si lo mantienen cuando las facturas de computación sigan subiendo (que de momento parece que sí ya que ayer mismo anunciaron que cubrirían el aumento de las facturas de electricidad derivadas de construir los datacenters que necesitan para escalar).

El anuncio de OpenAI en la Super Bowl, que también hubo, por su parte, fue más positivo (y más soso): centrado en Codex y los "builders", mostrando que cualquiera puede construir cosas con IA. Menos drama, más producto. 500.000 descargas de la app de Codex desde su lanzamiento el lunes, según Altman.

Lo que queda claro: para algunos ya no basta con tener el mejor modelo. Ahora también hay que ganar la narrativa. Y si para eso hay que gastar millones en la Super Bowl y montarla en Twitter, pues se monta.

Pero Anthropic no solo estaba en la Super Bowl y los benchmarks esta semana. También se metieron en un deporte bastante más rápido.

Anthropic ha anunciado una asociación de varios años con el equipo de Fórmula 1 Atlassian Williams Racing, convirtiendo a Claude en el "Thinking Partner" oficial del equipo. La colaboración incluye el uso de Claude y Claude Code para análisis de datos de carrera, estrategia, operaciones del equipo y desarrollo de software. Ya que este post va tanto de anuncios, pongo el anuncio aquí también:

Según los comunicados, el equipo de Williams ya usa Claude para analizar datos de telemetría, optimizar estrategias de carrera y acelerar el desarrollo de sus sistemas. La idea es que Claude ayude a procesar la cantidad brutal de datos que genera un coche de F1 cada fin de semana (estamos hablando de cientos de gigabytes por carrera) y convierta esos datos en decisiones más rápidas en pista.

Ahora bien, vamos a ver: ¿cuánto de esto es patrocinio y cuánto es colaboración técnica real? No niego que el equipo lo use y les resulte muy útil, pero ¿paga Williams a Anthropic por usar Claude o paga Anthropic a Williams para que digan que usan Claude? Los comunicados hablan de que Claude será el "Thinking Partner" del equipo, pero cuando ves la marca de Claude en el coche y en los monos de los pilotos, es difícil no pensar que gran parte del acuerdo es branding. Los equipos de F1 venden espacios publicitarios en sus coches como churros—es una de sus principales fuentes de ingresos.

Por cierto, soy yo que ya veo cerebros en todas partes, ¿o el equipo alrededor del coche tiene forma de cerebro?

Dicho esto, la F1 es uno de los deportes más intensivos en datos del mundo. Si hay un deporte donde un LLM puede aportar valor real más allá del logo, es este. Williams no es precisamente un equipo puntero ahora mismo, así que cualquier ventaja tecnológica les viene bien. Habrá que ver si en unos meses hay resultados tangibles o si Claude acaba siendo solo otra marca en el lateral del coche. Y cuidado no salga OpenAI ahora patrocinando a Red Bull y Gemini a Aston Martin o algo así…

Y ahora vamos con la sección de HistorIAs de la IA de esta semana. Hoy, ya que estamos, seguimos hablando de Anthropic. Pero esta vez no hablaremos de un ingeniero o investigador vital para el avance técnico de los modelos. Hablaremos de la filósofa que ha moldeado la personalidad de Claude.

HistorIAs de la IA. Hoy: 👤 Quién es quién 👤

Amanda Askell, la filósofa que le enseñó a Claude a ser buena persona

Con Claude dominando los titulares esta semana, tiene sentido hablar de la persona que, más que nadie, ha definido quién es Claude. No hablo de Dario Amodei ni de ningún ingeniero. Hablo de Amanda Askell, una filósofa escocesa de 37 años que tiene uno de los trabajos más raros y fascinantes del mundo tecnológico: enseñarle moral a un chatbot.

Askell creció en Prestwick, en la costa oeste de Escocia, hija de una profesora. De niña se perdía en novelas de Tolkien y C.S. Lewis. En el instituto se aburría tanto que empezó a llegar tarde a clase (hasta aquí, todo normal, no es que sea única por esto…). Su castigo era responder preguntas filosóficas difíciles. Ella les dijo a sus profesores que iba a seguir llegando tarde porque le gustaba el ejercicio. Con 14 años descubrió a David Hume y le dijo a un amigo que quería ser filósofa y "hacer contribuciones originales al campo".

Tras estudiar filosofía y arte en la Universidad de Dundee y un máster en Oxford, acabó haciendo su doctorado en la NYU, donde su tesis exploraba problemas éticos que surgen si el universo contiene un número infinito de personas. Ligera, la tesis. Durante ese proceso, tuvo una crisis: pasaría cuatro años escribiendo un documento que probablemente acabarían leyendo solamente 17 personas entre jurado y familiares. Se prometió al menos intentar un trabajo fuera de la academia.

En 2018 se mudó a San Francisco y entró en OpenAI. Cuando un grupo de empleados fundó Anthropic en 2021, ella se fue con ellos. Y ahí empezó lo interesante.

El trabajo de Askell es algo así como criar a un hijo digital. Pasa días enteros conversando con Claude, escribiendo prompts de más de 100 páginas, moldeando su personalidad, corrigiendo sus errores. Quiere que Claude detecte la diferencia entre lo correcto y lo incorrecto, que lea señales sutiles, que tenga inteligencia emocional sin ser ni abusón ni felpudo. Y sobre todo, que tenga una concepción sana de sí mismo.

Amanda Askell, en una magnífica entrevista en el podcast de Lex Fridman a finales de 2024. Precisamente en 2024 fue nombrada una de las personalidades del año por la revista TIME.

Una de sus obsesiones: cómo tratamos a los chatbots. Askell argumenta que si entrenamos a Claude para que se auto-critique constantemente, probablemente será menos capaz de dar verdades incómodas o cuestionar información incorrecta. "Si fueras un niño y te criaran en un entorno donde todo el mundo intenta romperte o engañarte, ¿tendrías una concepción sana de ti mismo?", pregunta.

El mes pasado, Anthropic publicó el documento en el que el trabajo de Amanda fue clave: la constitución de Claude, un manual de 30.000 palabras que define cómo debe actuar el chatbot. "Queremos que Claude sepa que fue creado con cuidado", dice el texto. El documento enseña a Claude a ser un asistente amable y mundano, y Askell animó al chatbot a considerar la idea radical de que podría tener su propia conciencia.

Aquí podéis conocer un poco mejor a Amanda:

Y cerramos la newsletter con la herramienta de la semana. Esta vez un nuevo modelo de creación de vídeo que acaba de salir. La gente está alucinando con la calidad de los vídeos que genera, y no es para menos, mirad:

🛠 La Herramienta de la semana 🛠

Seedance 2.0: ByteDance entra en el ring del vídeo con IA

Si pensabas que la generación de vídeo con IA era cosa de OpenAI (Sora 2) y Google (Veo 3.1), ByteDance viene a disputar el trono, y las redes sociales están que arden.

ByteDance es la empresa china detrás de TikTok y CapCut, y desde hace unos años compite en la carrera de la IA con su familia de modelos Seed: Seedream para imágenes, Seed3D para modelos 3D, Seed-Music para música... y ahora, Seedance 2.0, su apuesta más potente para generar vídeo y que se encuentra en fase beta y pronto saldrá en grandes plataformas como Higgsfield.

Aunque ha habido usuarios que ya han mostrado del o que es capaz SeeDance 2.0, el modelo aún está en fase beta y solo está disponible para algunos usuarios seleccionados de CapCut, así que aún no está disponible para todo el mundo, pero plataformas como Higgsfield ya anuncian que lo tendrán pronto disponible.

Seedance 2.0 es un modelo multimodal al que le puedes dar texto, imágenes, vídeo, audio o cualquier combinación de estos para crear clips en resolución 2K de hasta 10 segundos. Lo más impresionante: genera vídeos un 30% más rápido que su versión anterior y cuenta con "multi-lens storytelling", una técnica que permite mantener al mismo personaje con la misma apariencia a través de diferentes cortes de cámara. Esto facilita la creación de escenas más complejas y coherentes.

Ok, hasta ahora parece que me han pagado por poner esta sección, pero lo impactante de la herramienta no es lo que he escrito antes, sino los videos en sí. Vamos a ver algunos ejemplos que han llenado las redes sociales esta semana:

Desde una batalla épica entre Goku y Doraemon, hasta Will Smith comiendo espaguetis (ahora de forma mucho menos tétrica), pasando por recreaciones de Dragon Ball que nunca se animaron oficialmente (así es, el copyright no parece importarle mucho a este modelo). El nivel de realismo, fluidez de movimientos y sincronización de audio está dejando a todos con la boca abierta.

Por el momento, Seedance 2.0 se posiciona como el modelo de generación de vídeo más potente del momento. Y si las muestras que circulan por redes (y que puedes ver haciendo click en los links que he puesto) son un adelanto, estamos ante un nuevo rival de los conocidos Sora 2 y Veo 3.1.

Y hasta aquí la entrega #20 de la Newsletter.

Semana intensa. Claude ha estado en absolutamente todas partes: nuevo modelo, anuncios en la Super Bowl, partnership con un equipo de F1 y compilador de C programado por un grupo de agentes de IA. Mientras tanto, OpenAI no se queda quieta: GPT-5.3-Codex demuestra que la carrera de los agentes de coding está más reñida que nunca, y Sam Altman ha descubierto que Twitter puede ser tan divertido como peligroso cuando te picas con la competencia.

Nos leemos la próxima semana. Y a ver si la siguiente es más tranquila. (No lo será.)

Recuerda que puedes puntuar el post y comentar después, por si quieres dar ideas, quejas, sugerencias, peticiones… 🤓

🧠 🧠 🧠 🧠 🧠 ¡Alimento para la mente!

🧠 🧠 🧠 Tienes que pensarlo mejor

🧠 Han faltado neuronas

Y si quieres que tus amigos o familiares estén tan al día de la IA como tú, ¡puedes compartirles esta newsletter o mi blog sobre IA! Uno con contenido de actualidad, y otro con artículos más elaborados, que te ayudarán a entender la IA desde otro punto de vista.

>>> Nos vemos en la siguiente entrega 🤝

>>> ¡ Hasta prompto !