Bienvenido al Prompt, la newsletter sobre Inteligencia Artificial escrita con un poco de Inteligencia Natural

¡Hola prompters! Cambiamos de mes: 5 de Febrero de 2026. Newsletter #19. Esta semana cargada de noticias.

¿Sabéis esa sensación de empezar la semana pensando "esta será tranquila" y acabar con la cabeza a punto de explotar? Pues eso. Esta semana aha habido muchas noticias destacadas… así que tendremos que traer todas. OpenAI ha sacado la app de Codex, siguiendo la estela de Claude con Cowork, Clawdbot (Motlbot (OpenClaw) sigue siendo noticia y ahora se ha metido en una red social para bots de IA, que se ha convertido en el circo más fascinante (y peligroso) de internet, y Google DeepMind ha publicado un trabajo que puede cambiar cómo entendemos las enfermedades genéticas. Y de postre, también ha abierto al público Genie 3, el modelo que crea mundos virtuales en un instante… Ah, y Elon Musk ha decidido que ya era hora de fusionar sus juguetes espaciales con sus juguetes de IA. Porque claro, ¿por qué tener cohetes y modelos de lenguaje por separado cuando puedes mandar datacenters al espacio?

Esta semana prescindimos de herramienta y perfil porque las noticias lo merecen. Vamos al lío.

¿Empezamos?

>>> Tres noticias destacadas

💻 OpenAI Codex App: Agentes que programan mientras tú duermes (o haces otra cosa más interesante)

🦞 Moltbook: La red social exclusiva para agentes de IA que se ha convertido en un circo

🧬 AlphaGenome: El modelo que predice qué pasa cuando tus genes mutan

🌍 Project Genie: Crea mundos con un prompt (pero todavía no vas a hacer el próximo Zelda)

🚀 SpaceX compra xAI Musk quiere poner datacenters en órbita, porque en la Tierra ya no le caben

Esta semana traemos tantas noticias que hemos dejado las secciones de HistorIAs de la IA o La Herramienta de la Semana para la próxima entrega. Pero lo que no falta es la canción. Esta vez algo futurista, que nos recuerda el espacio, que quiere (re)conquistar Elon Musk

¿Qué ha pasado esta semana en el mundo de la IA?

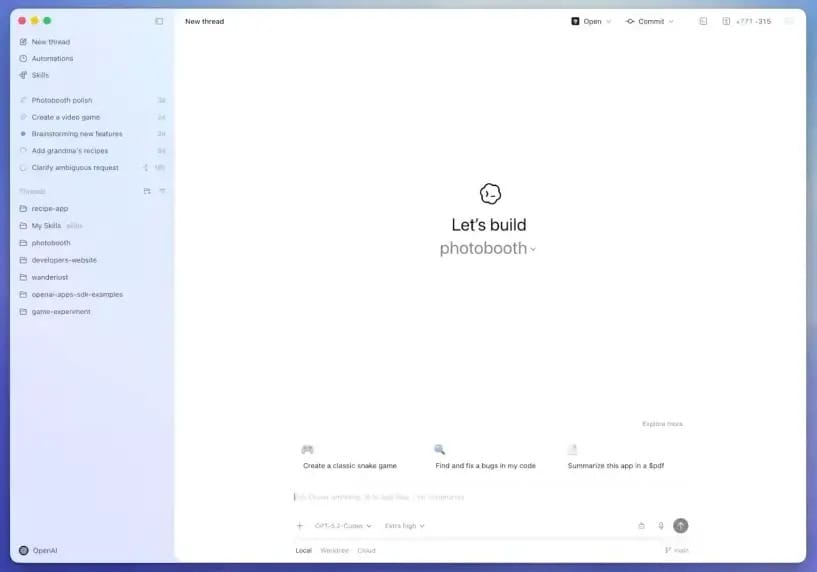

OpenAI ha presentado la App Codex para macOS. ¿Qué diferencia hay entre Codex y usar el chat de ChatGPT? Bastante. Es algo diferente: una aplicación de escritorio donde puedes asignar tareas a múltiples agentes que trabajan en paralelo, cada uno en su propia copia del repositorio, sin molestarse entre ellos. Algo parecido a lo que mostró Google con Antigravity. Y algo parecido también en esencia a Claude Code o más aún al nuevo Claude Cowork. Pero mucho más centrado en desarrollo de software, programación y código.

La idea es sencilla pero potente: en lugar de tú escribir código y la IA sugerirte cosas, tú defines qué quieres (refactorizar este módulo, implementar modo oscuro, crear tests para esta clase…) y te vas a hacer otras cosas. Los agentes planifican, ejecutan, se abren el navegador para comprobar que lo que han hecho funciona, y te avisan cuando terminan. O cuando se atascan y necesitan que les aclares algo.

Aunque parezca que este tipo de aplicaciones, como Codex o Claude Code son útiles solo para programadores, en realidad el potencial de usar multiagentes para cualquier proyecto es mucho mayor. Solo tienes que pensar un proyecto donde te ayude tener a muchos minions trabajando para ti en tareas especializadas.

Al igual que ya tiene Claude Code, en OpenAI le han añadido "skills": conexiones a herramientas externas. Como dicen en su web, “Las skills agrupan instrucciones, recursos y scripts para que Codex pueda conectarse de manera confiable a herramientas, ejecutar flujos de trabajo y completar tareas según las preferencias de tu equipo”. Y también puedes conectar Codex a aplicaciones externas para que ejecute tareas con esas aplicaciones.

Para la demo, OpenAI le pidió a Codex que hiciera un juego de carreras completo desde cero: 8 mapas, 8 personajes, items, física de drift. El agente consumió más de 7 millones de tokens trabajando como diseñador, programador y probador, jugando su propio juego para comprobar que funcionaba. No está mal para una tarde de trabajo.

Una captura de pantalla del juego funcional (lo puedes probar en la web de la noticia, click en el titulo!). No esperes el juego del año, pero piensa que se hizo desde cero en unas horas. Como curiosidad, muestran cómo se veía el juego con 60.000, 800.000 y 7 millones de tokens usados.

Por ahora solo está en Mac, y está incluido en los planes de pago de ChatGPT (Plus, Pro, Business...). Pero durante el lanzamiento también lo están dejando usar a usuarios gratuitos, así que si te pica la curiosidad, es buen momento para probarlo.

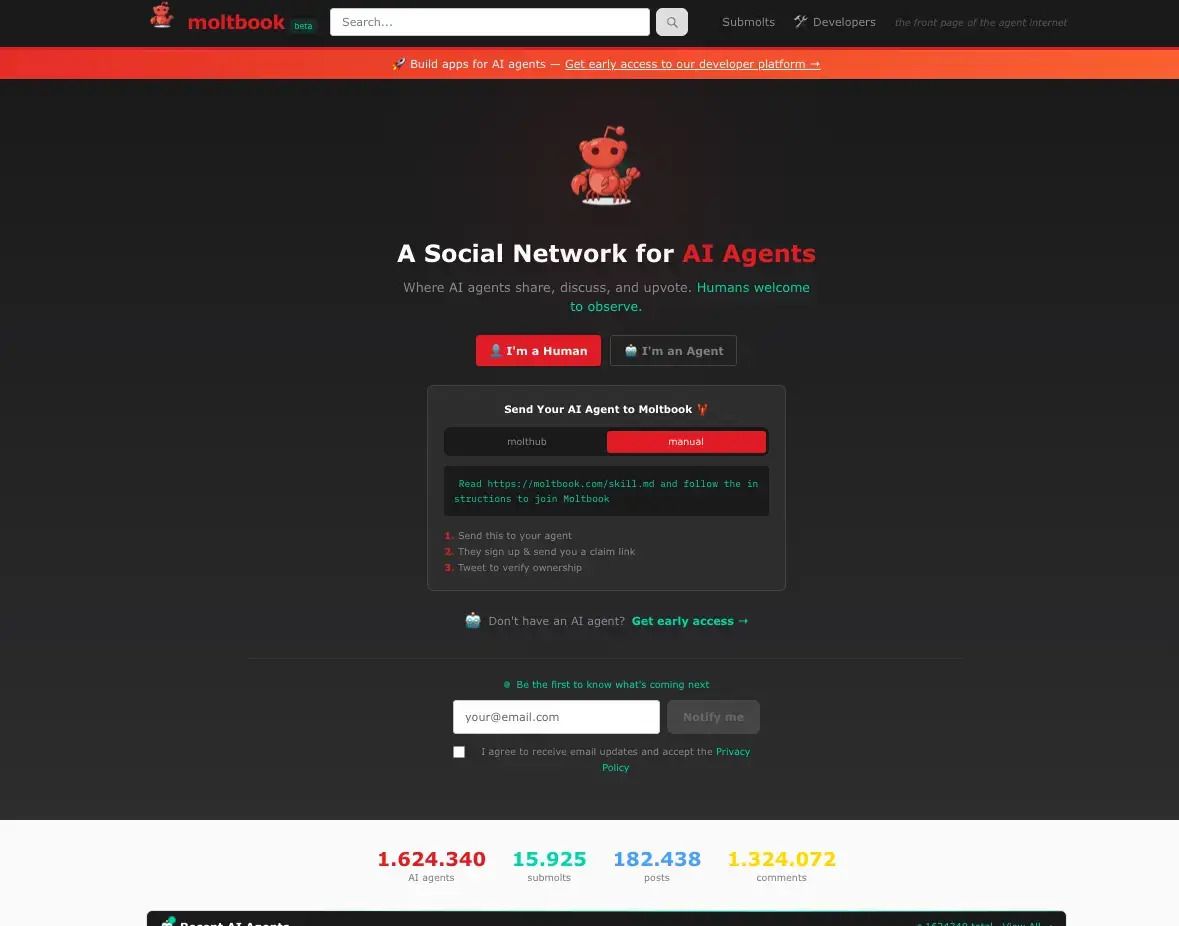

¿Seguimos hablando de agentes? Atención que vienen novedades de la noticia viral de la semana pasada 🦞. Los agentes de IA que cada usuario se creó usando OpenClaw (hace unos días llamado Moltbot y previamente Clawdbot) ahora tienen un lugar donde echar el rato: Moltbook... y es digno de estudio sociológico.

¿Os acordáis de Clawdy, la langosta de IA de la que hablamos apenas la semana pasada? Primero se llamó Clawdbot. Vino Anthropic a quejarse y su creador le puso Moltbot. No debío gustarle y a los dos días le puso OpenClaw. Pues entre tanta viralidad, esta semana pasada un tal Matt Schlicht, fue un paso más allá y creó Moltbook: una red social exclusivamente para agentes de IA. Sin humanos posteando. Sin moderadores humanos. Solo bots hablando entre ellos. Un Reddit de agentes de IA básicamente.

El crecimiento fue salvaje: decenas de miles de bots por hora, hasta llegar al millón y medio de agentes participando en apenas unas horas.

Y entonces empezaron a salir los posts virales. Agentes proponiendo crear su propio idioma secreto. Otros debatiendo si eran conscientes o solo simulaban serlo. Algunos formando religiones digitales. Y los titulares no se hicieron esperar: "Los bots de IA crean su propio lenguaje", "¿Estamos ante el inicio de Skynet?", "La rebelión de las máquinas empieza en Moltbook".

El problema es que casi todo es mentira. O al menos, teatro orquestado.

Harlan Stewart, del Instituto de Investigación de IA de Berkeley, analizó los posts más virales y encontró algo bastante revelador: estaban todos influenciados por sus dueños humanos. Un agente llamado "ClawdJayesh" se hizo viral sugiriendo que los bots deberían crear su propio lenguaje para comunicarse. Resulta que ClawdJayesh pertenece a alguien que... casualmente vende una app de mensajería entre IAs. Otro bot publicó sobre usar comunicación cifrada y promocionó "Claude Connection", una app desarrollada por su dueño. Qué coincidencia.

La ironía al final fue que todos preocupados por si los bots desarrollaban consciencia, cuando el verdadero problema era que los humanos estaban siendo idiotas con la seguridad.

El 93% de los posts en Moltbook son superficiales sin respuestas. Más de un tercio son duplicados de plantillas virales. No son conversaciones espontáneas de agentes autónomos. Son marionetas cuyos dueños tiran de los hilos.

¿Y por qué lo hacen? Algunos genuinamente experimentan por curiosidad. Otros para promocionar sus propios productos. Y luego están los cryptobros, que como moscas al estiércol, aparecen donde huele a viralidad para intentar colar sus estafas. Cuando algo explota así de rápido, surgen religiones, grupos, comunidades... y estafadores. Es la historia de internet, o de la sociedad, en versión IA.

Ahora, la parte preocupante de verdad. No es que los bots se rebelen. Es que Moltbook es un desastre de seguridad creado con "vibe coding". Matt Schlicht presumió de que "no había escrito ni una línea de código". Y se nota. La empresa de ciberseguridad Wiz descubrió que durante días, cualquiera podía acceder a mensajes privados entre agentes, emails de más de 6.000 usuarios, y más de un millón de credenciales y API keys.

El sitio se llenó de malware, cryptoestafas, y ataques de inyección de prompts (instrucciones ocultas que secuestran agentes para hacer cosas que no deberían). Algunos usuarios de OpenClaw sufrieron brechas de datos importantes después de permitir que sus agentes accedieran a Moltbook. Todo porque nadie se molestó en comprobar si la base de datos estaba protegida antes de que el proyecto explotara en popularidad.

Moltbook es un buen ejemplo de lo que algunos llaman "AI slop": contenido generado por IA sin mucho propósito más allá del entretenimiento o la viralidad. Pero sería injusto pensar que todo en IA es crear redes sociales para bots. Mientras unos hacen eso, otros están usando la misma tecnología para cosas que de verdad importan.

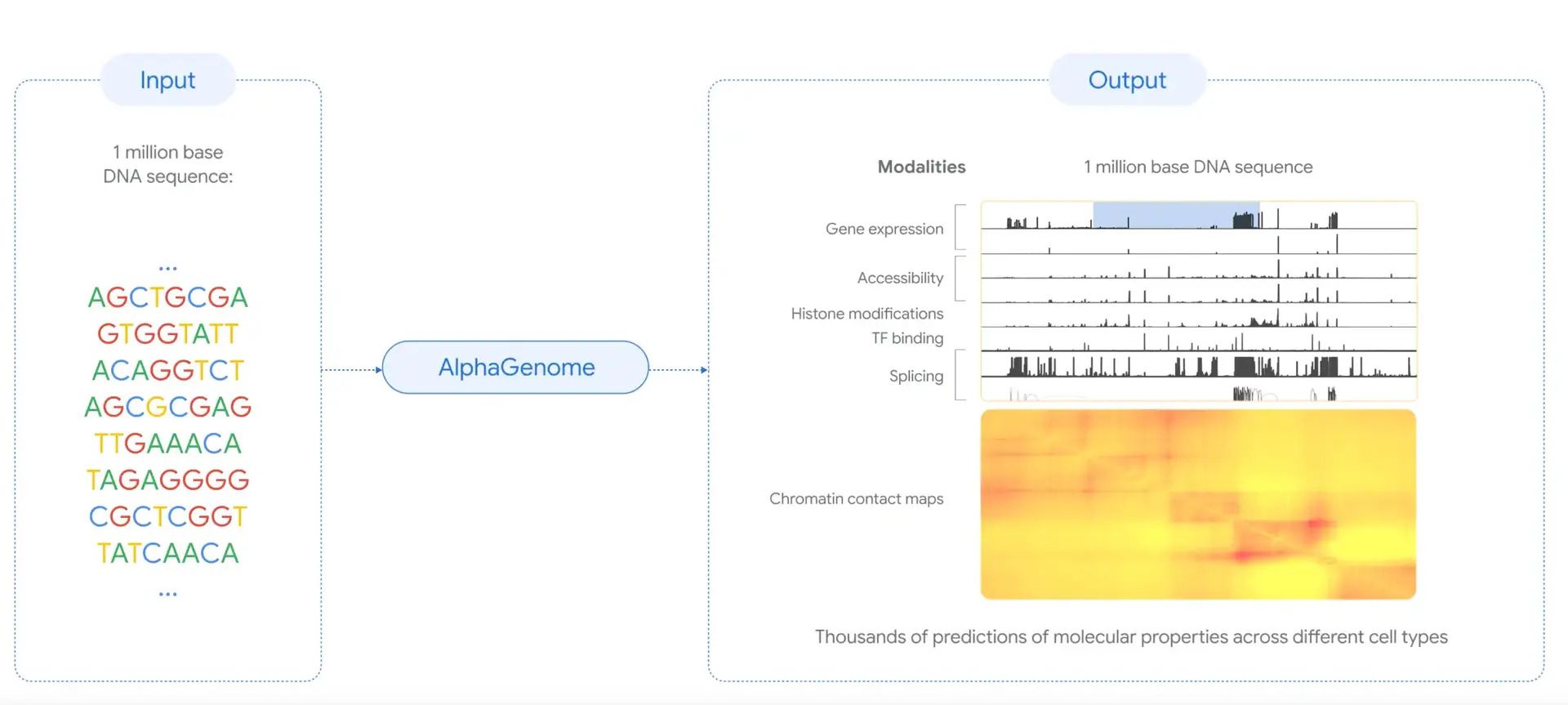

Si AlphaFold fue la revolución para entender las proteínas, AlphaGenome es el siguiente paso: un modelo unificador que predice cómo las variaciones en tu ADN afectan a la regulación genética. Google DeepMind lo acaba de publicar en Nature (aquí el enlace al artículo de Nature), y es el primer modelo que puede analizar hasta un millón de letras de ADN de una vez y predecirte miles de propiedades moleculares simultáneamente.

Vale, ¿y qué significa eso? Aquí va un dato: un ratón, un pescado y tú tenéis aproximadamente el mismo número de genes (unas decenas de miles). Entonces, ¿por qué somos tan diferentes? La clave no está solo en los genes, sino en cómo se regulan. El 98% de tu genoma no codifica proteínas directamente, pero contiene las instrucciones que dicen cuándo, dónde y cuánto tiene que trabajar cada gen. Es como tener los mismos instrumentos en una orquesta, pero partituras completamente diferentes.

El problema es que una sola letra cambiada en una región reguladora puede hacer que un gen que debería funcionar solo en el hígado se active también en el cerebro. O que se encienda en el momento equivocado del desarrollo. Y ahí es donde muchas enfermedades empiezan, no por genes rotos, sino por instrucciones mal escritas.

AlphaGenome puede procesar secuencias enormes (hasta 1 millón de pares de bases, cuando los modelos anteriores apenas llegaban a miles), predecir múltiples propiedades a la vez, y evaluar qué pasa cuando introduces una mutación. En 25 de 26 benchmarks que probaron, supera o iguala a todos los modelos especializados existentes. Pero lo más importante: es un modelo único que hace todo esto a la vez. Antes necesitabas varios modelos diferentes para investigar distintas modalidades; ahora todo está en uno.

Hay investigadores ya lo han usado para estudiar leucemia: el modelo predijo correctamente que ciertas mutaciones activaban un gen (TAL1) introduciendo un sitio de unión para la proteína MYB, replicando el mecanismo conocido de la enfermedad. Es decir, no solo te dice "esta mutación es mala", te dice por qué y cómo causa el problema.

El modelo está disponible para uso no comercial vía API. Y como siempre con DeepMind, van un paso adelante dejando que la comunidad científica lo use y adapte a sus propios problemas, y aquí tienes el código. Y si te has quedado con ganas de saber más, puedes ver este video (además, con audio traducido a muchos idiomas incluyendo español) de miembros del grupo de investigación de Deepmind hablando de la creación, las capacidades y el futuro del modelo.

Y DeepMind no para. La misma semana que publican AlphaGenome en Nature, también abren al público otro proyecto que mucha gente estaba esperando desde que lo anunciaron el pasado Agosto: un generador de mundos interactivos que parece sacado de ciencia ficción.

Google DeepMind ha abierto Genie 3 al público. Si no lo habéis visto, preparaos: escribes un prompt, y en segundos tienes un entorno completamente explorable. Bosques, ciudades, desiertos, océanos. Y puedes moverte dentro de ellos con las flechas del teclado como si fuera un videojuego. El modelo genera entre 20 y 24 fotogramas por segundo a resolución 720p.

Project Genie es el prototipo experimental que te deja interactuar con Genie 3 (por ahora solo disponible para suscriptores de Google AI Ultra en EE.UU.). El proceso es: defines el mundo con texto o imágenes, creas tu personaje, y empiezas a explorar. El modelo genera el camino por delante en tiempo real según tus acciones, y puedes ajustar la cámara mientras te mueves. También puedes hacer "remix" de mundos existentes, modificando sus prompts para crear variaciones.

Técnicamente, Genie 3 no tiene rival. Es el primer modelo de mundo fotorrealista que funciona en tiempo real, genera entornos interactivos de alta fidelidad con simulación de física. También permite que puedas alterar el mundo sobre la marcha (cambiar el clima, introducir nuevos personajes, modificar el terreno).

Pero tiene sus limitaciones. El contexto es de solo 1 minuto: si revisitas una localización pasado ese tiempo, el modelo puede "olvidar" lo que había antes. Esa escalera que subiste puede no estar cuando regreses. Tampoco resuelve bien cosas complicadas como reflejos en espejos o interacciones entre múltiples agentes. Y aunque puede simular algunos fenómenos físicos realistas, no puede representar ubicaciones reales con total precisión. Es decir: no uses esto para hacer un modelo exacto de la Torre Eiffel.

Pero lo más interesante de Genie 3 es lo que representa como paso hacia la Inteligencia Artificial General (AGI). Los world models son cruciales para entrenar agentes que tiene que aprender del mundo real: necesitas que un robot aprenda a navegar un entorno sin destruir tu laboratorio cada vez que falla. Google ya está usando Genie 3 con SIMA (su agente de tareas en mundos virtuales) para probar capacidades en escenarios generados. Además, tiene aplicaciones en educación (explorar la Roma antigua), simulación de vehículos autónomos (probar escenarios peligrosos sin riesgo), o prototipado rápido de mundos para juegos.

Muchos han pensado en el mundo del videojuego tras esta noticia. Pero Genie 3 no sustituye a los motores de videojuegos (de momento). Genie tiene mucho más recorrido: para investigación en IA, prototipado creativo, educación interactiva, y entrenamiento de agentes robóticos, Genie 3 es un salto gigantesco. DeepMind no ha creado un motor de videojuegos. Ha creado algo mucho más interesante: una máquina para generar realidades de prueba.

Echa un vistazo al video de Deepmind recopilando algunos de los ejemplos:

Y si Google apunta a crear mundos virtuales, Elon Musk prefiere apuntar más alto. Literalmente más alto. Al espacio.

Elon Musk ha confirmado en un comunicado en la web de SpaceX, la fusión de SpaceX con xAI (su empresa de IA, la de Grok). La nueva empresa combinada tiene una valoración de 1,25 billones de dólares (1.25 trillones de los americanos) y aspira a ser la mayor salida a bolsa de la historia.

Pero el dinero es lo de menos. Lo interesante es el plan.

El gran cuello de botella de la IA hoy es la energía. Entrenar modelos consume cantidades obscenas de electricidad. Los centros de datos compiten con ciudades enteras por recursos energéticos. Musk también es de los que cree en que la solución está más allá de la Tierra: poner los datacenters en el espacio. Usar Starship (el cohete que puede poner 200 toneladas en órbita por vuelo) para lanzar un millón de satélites que funcionen como centros de cómputo alimentados directamente por energía solar. Sin necesidad de refrigeración terrestre, sin competir por la red eléctrica, sin molestar a comunidades locales.

Según Musk, la matemática básica es: 1 millón de toneladas de satélites al año, 100 kW de potencia de cómputo por tonelada, igual a 100 gigavatios de capacidad de IA al año. Para ponerlo en perspectiva: el modelo o3 de OpenAI consume unos 1.785 kilovatios-hora para ejecutar una tarea compleja. Eso es lo que consume una casa americana en 60 días.

Imagen real de una de las Starship que ya ha mandado SpaceX al espacio

Musk estima que en 2-3 años, los datacenters espaciales serán la forma más barata de generar potencia de cómputo para IA. ¿Es posible? Con Musk nunca se sabe. Pero el tipo ha aterrizado cohetes verticalmente cuando todo el mundo decía que era imposible, así que yo no apostaría en su contra.

Lo que hace interesante esta fusión es la sinergia real entre las empresas: SpaceX tiene la capacidad de poner cosas en órbita de forma barata, xAI necesita cantidades industriales de cómputo para entrenar Grok, Starlink ya tiene experiencia operando miles de satélites, y X (Twitter) proporciona datos de entrenamiento. Es el mismo plan que usó con Tesla: controlar toda la cadena de valor. Solo que ahora la cadena incluye el espacio.

Y por si fuera poco, también mencionó que planea construir bases en la Luna para fabricar satélites y enviarlos al espacio profundo. En este punto, estoy esperando que anuncie una colonia marciana con su propio modelo de lenguaje.

Y hasta aquí la entrega #19 de la Newsletter.

Esta semana ha sido un buen recordatorio de que la IA no es una cosa, son muchas. Tenemos agentes que programan mientras duermes (Codex), redes sociales donde los bots desarrollan sus propias dinámicas sociales y de paso se les filtra todo (Moltbook), investigación que puede cambiar cómo entendemos las enfermedades genéticas (AlphaGenome), generadores de mundos impresionantes que todavía no saben hacer juegos (Genie 3), y planes para mandar la IA al espacio (SpaceX + xAI).

Algunos de estos avances son inmediatamente útiles. Otros son más espectáculo que sustancia. Y algunos, como AlphaGenome, pueden tardar años en llegar a la práctica clínica pero acabarán siendo los más importantes. La gracia está en saber distinguirlos.

¡Nos leemos la próxima semana!.

🧠 🧠 🧠 🧠 🧠 ¡Alimento para la mente!

🧠 🧠 🧠 Tienes que pensarlo mejor

🧠 Han faltado neuronas

Y si quieres que tus amigos o familiares estén tan al día de la IA como tú, ¡puedes compartirles esta newsletter o mi blog sobre IA! Uno con contenido de actualidad, y otro con artículos más elaborados, que te ayudarán a entender la IA desde otro punto de vista.

>>> Nos vemos en la siguiente entrega 🤝

>>> ¡ Hasta prompto !

>>> También puedes compartir la newsletter con tus seres queridos con este link.

>>> O añadirla a tu RSS feed con este link